完善資料讓更多小伙伴認(rèn)識(shí)你,還能領(lǐng)取20積分哦,立即完善>

標(biāo)簽 > gpt

GPT分區(qū):全稱(chēng)為Globally Unique Identifier Partition Table,也叫做GUID分區(qū)表,它是UEFI 規(guī)范的一部分。

文章:338個(gè) 瀏覽:15505次 帖子:16個(gè)

導(dǎo)讀 本篇是作者從開(kāi)發(fā)人員的視角,圍繞著大模型正向推理過(guò)程,對(duì)大模型的原理的系統(tǒng)性總結(jié),希望對(duì)初學(xué)者有所幫助。 引言 什么是人工智能? 清華大學(xué)出版社出...

GPT,全稱(chēng)Generative Pretrained Transformer,是OpenAI公司在自然語(yǔ)言處理(NLP)領(lǐng)域的一項(xiàng)重大創(chuàng)新。這一模型不...

2024-07-10 標(biāo)簽:AIGPT自然語(yǔ)言處理 1451 0

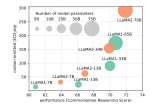

隨著人工智能技術(shù)的飛速發(fā)展,大語(yǔ)言模型(LLM)已成為自然語(yǔ)言處理領(lǐng)域的核心工具,廣泛應(yīng)用于智能客服、文本生成、機(jī)器翻譯等多個(gè)場(chǎng)景。然而,大語(yǔ)言模型的高...

OpenAI新研究:指令層次結(jié)構(gòu)防御LLM攻擊策略

為了解決這個(gè)問(wèn)題,這篇研究提出了一種指令層次結(jié)構(gòu)(instruction hierarchy)。它明確定義了不同指令的優(yōu)先級(jí),以及當(dāng)不同優(yōu)先級(jí)的指令發(fā)生...

將去除噪音后的結(jié)果數(shù)據(jù),利用視頻解碼器進(jìn)行解碼,將低維潛在空間數(shù)據(jù)還原成原始視頻數(shù)據(jù),這里可以實(shí)現(xiàn)不同分辨率的視頻解碼。

從技術(shù)路線看,依舊遵從LLM范式“大力出奇跡”,通過(guò)patches向量化與transformer架構(gòu)結(jié)合,使得訓(xùn)練數(shù)據(jù)能夠使用大小、尺寸、分辨率不同的視...

谷歌大型模型終于開(kāi)放源代碼,遲到但重要的開(kāi)源戰(zhàn)略

在人工智能領(lǐng)域,谷歌可以算是開(kāi)源的鼻祖。今天幾乎所有的大語(yǔ)言模型,都基于谷歌在 2017 年發(fā)布的 Transformer 論文;谷歌的發(fā)布的 BERT...

最近有位用戶(hù)想在 MATLAB 里用 m 代碼實(shí)現(xiàn)一個(gè)將某個(gè)圖形窗口最大化顯示的功能,問(wèn)我們有沒(méi)有 MATLAB 函數(shù)支持這個(gè)。

Continous Batching大模型推理關(guān)鍵技術(shù)

TurboTransformers算是比較早期指出輸入變長(zhǎng)需要新的Batching方法的論文。在2020年上半年,我開(kāi)始思考如何把變長(zhǎng)輸入Batchin...

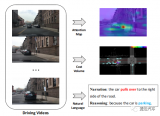

兩種端到端的自動(dòng)駕駛系統(tǒng)算法架構(gòu)

基于學(xué)習(xí)的自動(dòng)駕駛是一個(gè)活躍的研究領(lǐng)域。采用了一些基于學(xué)習(xí)的駕駛方法,例如可供性和強(qiáng)化學(xué)習(xí),取得了不錯(cuò)的性能,模仿方法也被用來(lái)回歸人類(lèi)演示的控制命令。

LLMs時(shí)代進(jìn)行無(wú)害性評(píng)估的基準(zhǔn)解析

隨著對(duì)LLMs的不斷應(yīng)用,大家也發(fā)現(xiàn)了諸多問(wèn)題。比如常見(jiàn)的幻覺(jué)現(xiàn)象,LLMs可喜歡一本正經(jīng)地說(shuō)著胡話(huà)呢。除此之外,LLMs也有可能生成一些歧視某些身份群...

首個(gè)無(wú)需依賴(lài)SAM的高效像素級(jí)推理大模型PixelLM問(wèn)世

進(jìn)一步,為了支持這一研究領(lǐng)域的模型訓(xùn)練和評(píng)估,研究團(tuán)隊(duì)在LVIS數(shù)據(jù)集的基礎(chǔ)之上,借助GPT-4V構(gòu)建了一個(gè)面向多目標(biāo)推理分割場(chǎng)景的數(shù)據(jù)集MUSE,它包...

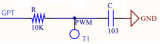

在項(xiàng)目調(diào)試過(guò)程中,需要監(jiān)控變量通常采用ICS(In Circuit Scope)和DA兩種方法。使用ICS會(huì)占用MCU的資源(UART)以及增加硬件的成...

從Google多模態(tài)大模型看后續(xù)大模型應(yīng)該具備哪些能力

前段時(shí)間Google推出Gemini多模態(tài)大模型,展示了不凡的對(duì)話(huà)能力和多模態(tài)能力,其表現(xiàn)究竟如何呢?

GPT推斷中的批處理(Batching)效應(yīng)簡(jiǎn)析

機(jī)器學(xué)習(xí)模型依賴(lài)于批處理(Batching)來(lái)提高推斷吞吐量,尤其是對(duì)于 ResNet 和 DenseNet 等較小的計(jì)算機(jī)視覺(jué)模型。

2023-12-18 標(biāo)簽:寄存器機(jī)器學(xué)習(xí)GPT 768 0

探索高效的大型語(yǔ)言模型!大型語(yǔ)言模型的高效學(xué)習(xí)方法

在大型語(yǔ)言模型(LLMs)的應(yīng)用中,提示工程(Prompt Engineering)是一種關(guān)鍵技術(shù),用于引導(dǎo)模型生成特定輸出或執(zhí)行特定任務(wù)。通過(guò)精心設(shè)計(jì)...

2023-12-13 標(biāo)簽:cpuGPTTransformer 664 0

什么是神經(jīng)網(wǎng)絡(luò)?神經(jīng)網(wǎng)絡(luò)是如何工作的?GPT與神經(jīng)網(wǎng)絡(luò)的關(guān)系

作為一名程序員,我們習(xí)慣于去了解所使用工具、中間件的底層原理,本文則旨在幫助大家了解 AI 模型的底層機(jī)制,讓大家在學(xué)習(xí)或應(yīng)用各種大模型時(shí)更加得心應(yīng)手,...

2023-12-13 標(biāo)簽:神經(jīng)網(wǎng)絡(luò)RGB人工智能 1818 0

AI模型底層機(jī)制解析GPT與神經(jīng)網(wǎng)絡(luò)的關(guān)系

GPT 想必大家已經(jīng)耳熟能詳,當(dāng)我們與它進(jìn)行對(duì)話(huà)時(shí),通常只需關(guān)注自己?jiǎn)柍龅膯?wèn)題(輸入)以及 GPT 給出的答案(輸出),對(duì)于輸出內(nèi)容是如何產(chǎn)生的,我們一...

2023-12-13 標(biāo)簽:神經(jīng)網(wǎng)絡(luò)神經(jīng)系統(tǒng)AI 1529 0

換一批

換一批

編輯推薦廠商產(chǎn)品技術(shù)軟件/工具OS/語(yǔ)言教程專(zhuān)題

| 電機(jī)控制 | DSP | 氮化鎵 | 功率放大器 | ChatGPT | 自動(dòng)駕駛 | TI | 瑞薩電子 |

| BLDC | PLC | 碳化硅 | 二極管 | OpenAI | 元宇宙 | 安森美 | ADI |

| 無(wú)刷電機(jī) | FOC | IGBT | 逆變器 | 文心一言 | 5G | 英飛凌 | 羅姆 |

| 直流電機(jī) | PID | MOSFET | 傳感器 | 人工智能 | 物聯(lián)網(wǎng) | NXP | 賽靈思 |

| 步進(jìn)電機(jī) | SPWM | 充電樁 | IPM | 機(jī)器視覺(jué) | 無(wú)人機(jī) | 三菱電機(jī) | ST |

| 伺服電機(jī) | SVPWM | 光伏發(fā)電 | UPS | AR | 智能電網(wǎng) | 國(guó)民技術(shù) | Microchip |

| Arduino | BeagleBone | 樹(shù)莓派 | STM32 | MSP430 | EFM32 | ARM mbed | EDA |

| 示波器 | LPC | imx8 | PSoC | Altium Designer | Allegro | Mentor | Pads |

| OrCAD | Cadence | AutoCAD | 華秋DFM | Keil | MATLAB | MPLAB | Quartus |

| C++ | Java | Python | JavaScript | node.js | RISC-V | verilog | Tensorflow |

| Android | iOS | linux | RTOS | FreeRTOS | LiteOS | RT-THread | uCOS |

| DuerOS | Brillo | Windows11 | HarmonyOS |