近日,谷歌公司推出了一款新型圖像標(biāo)注方式 “流體標(biāo)注”,即采用機(jī)器學(xué)習(xí)來注釋分類標(biāo)簽并勾勒出圖片中的每個對象和背景區(qū)域。谷歌表示其可將標(biāo)記數(shù)據(jù)集的速度提高3倍。

據(jù)悉,谷歌推出的流體標(biāo)注模型主要利用人工智能學(xué)習(xí)的基礎(chǔ),對圖像數(shù)據(jù)進(jìn)行自動標(biāo)注,對于標(biāo)注不準(zhǔn)確或者出現(xiàn)偏差的地方可以通過人工調(diào)整,從而提高標(biāo)注效率。即便該模型可借助機(jī)器學(xué)習(xí)提升標(biāo)注速度,但最初還需進(jìn)行人為地?cái)?shù)據(jù)標(biāo)注,為其提供初始訓(xùn)練數(shù)據(jù)集。事實(shí)也正是如此,為了標(biāo)注圖片,谷歌預(yù)先以約一千張具有分類標(biāo)簽和信任分?jǐn)?shù)的圖片訓(xùn)練了語意分割模型。但該模型尚不完美,谷歌稱,物體邊界標(biāo)記問題、界面操作速度以及類別擴(kuò)展等仍需進(jìn)一步研究或完善。

傳統(tǒng)手動標(biāo)記(中列)和流體標(biāo)注(右)比較

-

谷歌

+關(guān)注

關(guān)注

27文章

6196瀏覽量

106017 -

機(jī)器學(xué)習(xí)

+關(guān)注

關(guān)注

66文章

8441瀏覽量

133087

原文標(biāo)題:谷歌推出新型圖像標(biāo)注方式

文章出處:【微信號:robotmagazine,微信公眾號:機(jī)器人技術(shù)與應(yīng)用】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

相關(guān)推薦

谷歌機(jī)器學(xué)習(xí)獲重大突破

機(jī)器學(xué)習(xí)技術(shù)在圖像處理中的應(yīng)用

機(jī)器學(xué)習(xí)的圖像壓縮應(yīng)用

新聞圖像人臉標(biāo)注方法

基于卷積神經(jīng)網(wǎng)絡(luò)的圖像標(biāo)注模型

基于圖像自動標(biāo)注技術(shù)研究

基于SAE的自動圖像標(biāo)注算法

谷歌推出一款基于AI和深度學(xué)習(xí)的圖像標(biāo)注方式“流體標(biāo)注”

谷歌新聞:谷歌解雇48名員工 新推機(jī)器學(xué)習(xí)標(biāo)注圖片功能

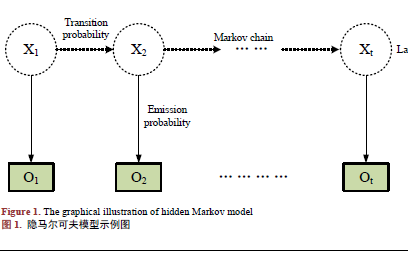

基于隱馬爾科夫模型和卷積神經(jīng)網(wǎng)絡(luò)的圖像標(biāo)注方法

谷歌推出開源的量子機(jī)器學(xué)習(xí)庫TensorFlow Quantum

谷歌希望通過圖片標(biāo)注來幫助訓(xùn)練其人工智能

基于強(qiáng)化學(xué)習(xí)的壯語詞標(biāo)注方法

圖像標(biāo)注如何提升效率?

谷歌推出基于機(jī)器學(xué)習(xí)的圖像標(biāo)注方式

谷歌推出基于機(jī)器學(xué)習(xí)的圖像標(biāo)注方式

評論