神經(jīng)網(wǎng)絡(luò)是在許多用例中提供了精確狀態(tài)的機器學(xué)習(xí)算法。但是,很多時候,我們正在構(gòu)建的網(wǎng)絡(luò)的準確性可能并不令人滿意,也可能不會讓我們在數(shù)據(jù)科學(xué)競賽中處于領(lǐng)先地位。因此,我們一直在尋找更好的方法來提高我們的模型的性能。有很多技術(shù)可以幫助我們實現(xiàn)這一點。

檢查過度擬合

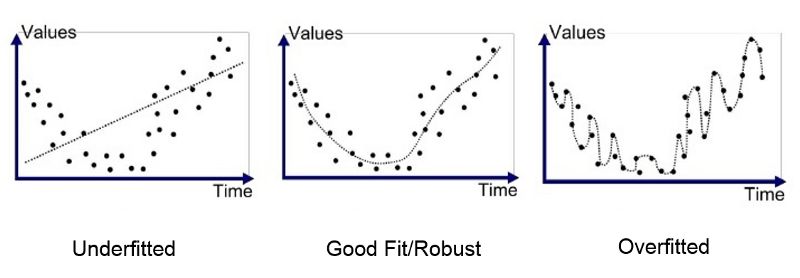

確保你的神經(jīng)網(wǎng)絡(luò)在測試數(shù)據(jù)上表現(xiàn)良好的第一步是驗證你的神經(jīng)網(wǎng)絡(luò)不會過度擬合。什么是過度擬和?當(dāng)模型開始從訓(xùn)練數(shù)據(jù)中記憶數(shù)值而不是從訓(xùn)練數(shù)據(jù)中學(xué)習(xí)時,就會發(fā)生過擬合。因此,當(dāng)您的模型遇到以前從未見過的數(shù)據(jù)時,它不能很好地執(zhí)行它們。

為了讓你更好的理解,讓我們來打個比方。我們都會有一個善于記憶的同學(xué),假設(shè)數(shù)學(xué)考試即將來臨。你和你擅長記憶的朋友從課本上開始學(xué)習(xí)。你的朋友決定背誦課本上的每個公式、問題和答案,但你比他聰明,所以你決定建立在直覺的基礎(chǔ)上,解決問題,學(xué)習(xí)這些公式是如何發(fā)揮作用的。測試一天到來,如果試卷的問題是采取直接從課本,那么你的朋友會做得更好,但如果問題涉及新的應(yīng)用知識,你會做得更好,而你依賴記憶的朋友會失敗得很慘。

如何鑒別你的模型是否過度擬和?你只需要交叉檢驗訓(xùn)練準確度和測試準確度如果訓(xùn)練準確度遠遠高于測試準確度,那么你就可以假設(shè)你的模型過度擬和了。你也可以將預(yù)測點畫在圖表上來驗證。以下是一些防止過度擬和的技術(shù):

數(shù)據(jù)規(guī)范化(L1或L2)。

退出——在神經(jīng)元之間隨機刪除連接,迫使網(wǎng)絡(luò)找到新的路徑并進行歸納。

早期停止——加速神經(jīng)網(wǎng)絡(luò)的訓(xùn)練,減少測試集的誤差。

超參數(shù)調(diào)優(yōu)

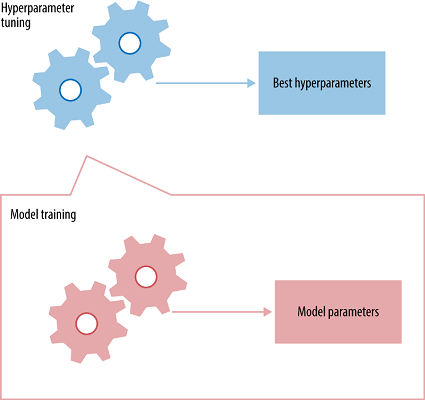

超參數(shù)是必須初始化到網(wǎng)絡(luò)的值,這些值是神經(jīng)網(wǎng)絡(luò)在訓(xùn)練時無法學(xué)習(xí)到的。例如:在卷積神經(jīng)網(wǎng)絡(luò)中,一些超參數(shù)是內(nèi)核大小、神經(jīng)網(wǎng)絡(luò)中的層數(shù)、激活函數(shù)、丟失函數(shù)、使用的優(yōu)化器(梯度下降、RMSprop)、批處理大小、要訓(xùn)練的周期數(shù)等。

每一個神經(jīng)網(wǎng)絡(luò)都將有其最好的超參數(shù)集,以達到致最大的準確性。你可能會問,“有這么多超參數(shù),我如何選擇?”不幸的是,沒有直接的方法來辨別出每一個神經(jīng)網(wǎng)絡(luò)的最佳超參數(shù)集,所以它主要是通過反復(fù)試驗得到的。但是,對于下面提到的超參數(shù)有一些實踐技巧:

學(xué)習(xí)速率

選擇一個最優(yōu)的學(xué)習(xí)速率很重要,因為它決定了你的網(wǎng)絡(luò)是否收斂到全局最小值。選擇一個高學(xué)習(xí)率幾乎不會讓你達到全局最優(yōu),因為你很有可能超過它。因此,你總是在全局最小點附近,但從不收斂于它。選擇一個低的學(xué)習(xí)速率可以幫助神經(jīng)網(wǎng)絡(luò)收斂到全局最小值,但是需要花費大量的時間。因此,你必須對網(wǎng)絡(luò)進行長時間的訓(xùn)練。一個低的學(xué)習(xí)速率也會使網(wǎng)絡(luò)容易陷入局部最小值,例如,網(wǎng)絡(luò)會收斂到局部最小值,由于學(xué)習(xí)速率小,無法從中掙脫出來。因此,在設(shè)置學(xué)習(xí)率時必須小心。

網(wǎng)絡(luò)架構(gòu)

在所有的測試用例中,沒有一個永遠帶來高準確性的標準的體系結(jié)構(gòu)。你必須進行實驗,嘗試不同的架構(gòu),從結(jié)果中獲得推斷,然后再嘗試。我的一個建議是使用經(jīng)過驗證的架構(gòu),而不是構(gòu)建自己的架構(gòu)。例如:對于圖像識別任務(wù),你可以使用VGG net, Resnet,谷歌的Inceptionnetwork等。這些都是開源的,并且已經(jīng)被證明非常準確,因此,你可以復(fù)制他們的架構(gòu)并根據(jù)你的目的調(diào)整它們。

優(yōu)化器和損失函數(shù)

有無數(shù)可供選擇的選項。事實上,你甚至可以在必要時定義自定義損失函數(shù)。常用的優(yōu)化方法有RMSprop、Stochastic Gradient Descent和Adam。這些優(yōu)化器似乎適用于大多數(shù)用例。如果你的用例是一個分類任務(wù),那么通常使用的損失函數(shù)是分類交叉熵。如果您正在執(zhí)行一個回歸任務(wù),均方誤差是常用的損失函數(shù)。可以自由地嘗試這些優(yōu)化器的超參數(shù),也可以使用不同的優(yōu)化器和損失函數(shù)。

批處理大小和epoch的數(shù)量

同樣,對于所有用例來說,沒有標準的批處理大小和epoch數(shù)量。你必須嘗試不同的方法。在一般的實踐中,批量大小的值設(shè)置為8、16、32,而epoch的數(shù)量取決于開發(fā)人員的偏好和他擁有的計算能力。

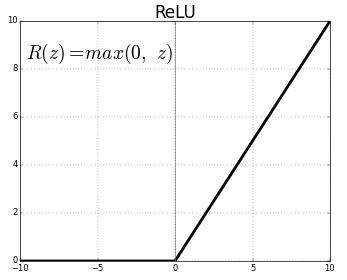

激活函數(shù)——激活函數(shù)將非線性函數(shù)的輸入映射到輸出。激活函數(shù)非常重要,且選擇正確的激活函數(shù)有助于你的模型更好地學(xué)習(xí)。如今,糾正線性單元(ReLU)是使用最廣泛的激活函數(shù),因為它解決了梯度消失的問題。早些時候S狀彎曲和雙曲正切是使用最廣泛的激活函數(shù)。但是,他們遭受了梯度消失的問題,例如:梯度反向傳播的過程中,當(dāng)他們到達開始層時梯度的數(shù)值就開始減少。這阻止了神經(jīng)網(wǎng)絡(luò)擴展到更大的規(guī)模與更多的層。ReLU能夠克服這個問題,從而使神經(jīng)網(wǎng)絡(luò)能有更大的規(guī)模。

整體算法

如果單個神經(jīng)網(wǎng)絡(luò)并不像你預(yù)期中那么準確,你可以創(chuàng)建一個神經(jīng)網(wǎng)絡(luò)的集合并結(jié)合它們的預(yù)測能力。你可以選擇不同的神經(jīng)網(wǎng)絡(luò)架構(gòu),在數(shù)據(jù)的不同部分對它們進行訓(xùn)練,并對它們進行集成,使用它們的集體預(yù)測能力來獲得測試數(shù)據(jù)的高準確度。假設(shè),你正在構(gòu)建一個貓與狗的分類器,0表示貓,1表示狗。當(dāng)將不同的貓和狗的分類器組合在一起時,基于各個分類器之間的皮爾遜相關(guān)性,集成算法的精度得到了提高。讓我們來看一個例子,取3個模型并測量它們各自的準確性:

Ground Truth: 1111111111Classifier 1: 1111111100 = 80% accuracyClassifier 2: 1111111100 = 80% accuracyClassifier 3: 1011111100 = 70% accuracy

三種模型的皮爾遜相關(guān)系數(shù)很高。因此,組合它們并不能提高準確性。如果我們使用多數(shù)投票對上述三個模型進行組合,我們將得到以下結(jié)果:

Ensemble Result: 1111111100 = 80% accuracy

現(xiàn)在讓我們來看看皮爾遜相關(guān)系數(shù)很低的3個模型:

Ground Truth: 1111111111Classifier 1: 1111111100 = 80% accuracyClassifier 2: 0111011101 = 70% accuracyClassifier 3: 1000101111 = 60% accuracy

當(dāng)我們把這三個模型合在一起時,我們得到了以下的結(jié)果:

Ensemble Result: 1111111101 = 90% accuracy

由此可見,低皮爾遜相關(guān)系數(shù)的模型組合能夠得出比高皮爾遜相關(guān)系數(shù)組合更精確的結(jié)果。

數(shù)據(jù)不足的問題

在執(zhí)行上述所有技巧之后,如果你的模型在測試數(shù)據(jù)集中仍然沒有表現(xiàn)得更好,那么可以將其歸因于缺少訓(xùn)練數(shù)據(jù)。在許多用例中,可用的培訓(xùn)數(shù)據(jù)的數(shù)量是有限的。如果你無法收集更多的數(shù)據(jù),那么可以使用數(shù)據(jù)增強技術(shù)。

如果你正在處理一個圖像數(shù)據(jù)集,您可以通過剪切圖像、翻轉(zhuǎn)圖像、隨機剪切圖像等方式來增加訓(xùn)練數(shù)據(jù)的新圖像。這可以為神經(jīng)網(wǎng)絡(luò)提供不同的示例。

-

神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

42文章

4781瀏覽量

101178 -

機器學(xué)習(xí)

+關(guān)注

關(guān)注

66文章

8441瀏覽量

133089

原文標題:【譯】如何提升神經(jīng)網(wǎng)絡(luò)的表現(xiàn)

文章出處:【微信號:AI_shequ,微信公眾號:人工智能愛好者社區(qū)】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

相關(guān)推薦

分享機器學(xué)習(xí)卷積神經(jīng)網(wǎng)絡(luò)的工作流程和相關(guān)操作

機器學(xué)習(xí)神經(jīng)網(wǎng)絡(luò)參數(shù)的代價函數(shù)

【案例分享】基于BP算法的前饋神經(jīng)網(wǎng)絡(luò)

如何設(shè)計BP神經(jīng)網(wǎng)絡(luò)圖像壓縮算法?

卷積神經(jīng)網(wǎng)絡(luò)模型發(fā)展及應(yīng)用

卷積神經(jīng)網(wǎng)絡(luò)簡介:什么是機器學(xué)習(xí)?

不可錯過!人工神經(jīng)網(wǎng)絡(luò)算法、PID算法、Python人工智能學(xué)習(xí)等資料包分享(附源代碼)

BP神經(jīng)網(wǎng)絡(luò)模型與學(xué)習(xí)算法

為什么使用機器學(xué)習(xí)和神經(jīng)網(wǎng)絡(luò)以及需要了解的八種神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu)

基于脈沖神經(jīng)網(wǎng)絡(luò)的遷移學(xué)習(xí)算法

卷積神經(jīng)網(wǎng)絡(luò)算法是機器算法嗎

人工神經(jīng)網(wǎng)絡(luò)的原理和多種神經(jīng)網(wǎng)絡(luò)架構(gòu)方法

神經(jīng)網(wǎng)絡(luò)是在許多用例中提供了精確狀態(tài)的機器學(xué)習(xí)算法

神經(jīng)網(wǎng)絡(luò)是在許多用例中提供了精確狀態(tài)的機器學(xué)習(xí)算法

評論