引言

自然語言處理(Natural Language Processing, NLP)作為人工智能領域的一個重要分支,旨在讓計算機能夠理解和處理人類語言。隨著深度學習技術的興起,前饋神經網絡(Feedforward Neural Networks, FNN)作為深度學習的一種基本形式,在NLP中發揮著越來越重要的作用。本文將從前饋神經網絡的基本原理、結構特點出發,詳細探討其在NLP中的應用場景、優勢以及面臨的挑戰,并展望其未來的發展方向。

一、前饋神經網絡的基本原理與結構特點

前饋神經網絡是一種最基本的神經網絡結構,其信息流只能從輸入層到輸出層單向傳播,不能在網絡中形成閉環。FNN通常由輸入層、一個或多個隱藏層以及輸出層組成。信息在FNN中從輸入層經過隱藏層逐層向前傳播,最終到達輸出層。在每個神經元中,輸入的加權和經過激活函數后得到輸出,作為下一層的輸入。

FNN的核心在于其強大的特征學習和表示能力。通過多層神經元的非線性變換和特征提取,FNN能夠自動學習輸入數據的復雜特征,并將其映射到輸出層,實現對未知數據的預測和分類。此外,FNN還具有計算速度快、易于實現和訓練等優點,適用于處理高維數據,如文本數據。

二、前饋神經網絡在自然語言處理中的應用場景

- 文本分類

文本分類是NLP中的一項基礎任務,旨在將文本數據劃分為預定義的類別。FNN在文本分類中發揮著重要作用,特別是在情感分析、主題分類等領域。通過將文本數據轉換為向量表示,FNN能夠學習文本數據的特征,并將其映射到不同的類別中。例如,在情感分析中,FNN可以學習文本的詞向量表示和語義信息,自動將文本分類為正面、負面或中性情感傾向。 - 命名實體識別(Named Entity Recognition, NER)

NER是NLP中的另一項重要任務,旨在從文本中識別出具有特定意義的實體,如人名、地名、機構名等。FNN在NER任務中同樣表現出色。通過學習文本中的實體邊界和類型信息,FNN能夠準確識別出文本中的實體,為后續的NLP任務提供有力支持。 - 機器翻譯

雖然FNN在機器翻譯任務中不如循環神經網絡(RNN)和變壓器(Transformer)等模型表現突出,但在某些特定的翻譯任務中,FNN仍然可以發揮一定的作用。通過學習源語言和目標語言之間的映射關系,FNN能夠實現簡單的翻譯任務,為更復雜的翻譯模型提供基礎。 - 問答系統

問答系統是NLP中的一個高級應用,旨在回答用戶提出的問題。FNN在問答系統中可以用于理解用戶的問題,并從大量文本數據中提取相關信息來生成答案。通過學習問題的語義和上下文信息,FNN能夠更準確地理解用戶意圖,并生成更相關的答案。 - 文本生成

文本生成是NLP中的一個挑戰性任務,旨在生成符合語法和語義規則的文本。FNN在文本生成中也有一定的應用,如生成式對抗網絡(GAN)中的生成器部分就可以采用FNN結構。通過學習大量文本數據的特征,FNN能夠生成與輸入文本相似或具有特定風格的文本。

三、前饋神經網絡在自然語言處理中的優勢

- 強大的特征學習和表示能力

FNN通過多層神經元的非線性變換和特征提取,能夠自動學習輸入數據的復雜特征,并將其表示為向量形式。這種向量表示不僅便于計算,而且能夠捕捉文本之間的相似性和差異性,為后續的NLP任務提供有力的支持。 - 計算速度快

由于FNN的信息流是單向傳播的,沒有反饋機制,因此其計算速度相對較快。這使得FNN適用于處理大規模文本數據,特別是在實時應用場景中表現出色。 - 易于實現和訓練

FNN的結構相對簡單,易于實現和訓練。這使得研究者可以更快地搭建和測試模型,加速NLP領域的研究進展。

四、前饋神經網絡在自然語言處理中面臨的挑戰

- 無法捕捉序列中的時間依賴關系

FNN在處理序列數據(如文本)時,無法捕捉序列中的時間依賴關系。這意味著FNN在處理長文本或具有復雜結構的文本時可能會表現不佳。為了克服這一局限性,研究者們提出了循環神經網絡(RNN)和變壓器(Transformer)等模型來更好地處理序列數據。 - 對文本數據的長度和結構敏感

FNN對文本數據的長度和結構較為敏感。當文本數據的長度或結構發生變化時,FNN的性能可能會受到影響。因此,在使用FNN處理文本數據時,需要對文本數據進行適當的預處理和標準化操作。 - 需要大量標注數據進行監督學習

FNN在處理文本數據時通常需要大量的標注數據進行監督學習。然而,在實際應用中,高質量的標注數據往往難以獲得,這限制了FNN在某些場景下的應用。為了緩解這一問題,研究者們探索了半監督學習、無監督學習以及遷移學習等方法,以減少對標注數據的依賴。

五、前饋神經網絡在自然語言處理中的創新與發展

盡管FNN在NLP中面臨一些挑戰,但研究者們通過不斷的創新與發展,提出了多種改進方法,以增強FNN在NLP任務中的表現。

- 結合卷積神經網絡(CNN)

為了克服FNN在捕捉文本局部特征方面的不足,研究者們將卷積神經網絡(CNN)與前饋神經網絡相結合。CNN通過卷積和池化操作,能夠有效地提取文本中的局部特征,如n-gram特征、詞嵌入特征等。將CNN的輸出作為FNN的輸入,可以充分利用CNN的局部特征提取能力和FNN的全局特征學習能力,提升模型在文本分類、情感分析等任務中的性能。 - 注意力機制

注意力機制是一種模擬人類注意力行為的技術,它允許模型在處理文本時自動關注重要的部分,忽略不重要的部分。將注意力機制引入FNN中,可以使模型更加關注與任務相關的關鍵信息,提高模型的準確性和魯棒性。例如,在文本分類任務中,注意力機制可以幫助FNN更加關注文本中的關鍵詞或句子,從而做出更準確的分類決策。 - 預訓練模型

隨著計算能力的提升和大數據的積累,預訓練模型在NLP中變得越來越流行。預訓練模型通過在大規模語料庫上進行無監督學習,獲得了豐富的語言知識和表示能力。將預訓練模型的輸出作為FNN的輸入或嵌入層,可以顯著提升FNN在NLP任務中的表現。例如,BERT、GPT等預訓練模型已經成為許多NLP任務中的基礎工具,它們為FNN等模型提供了強大的語言表示能力。 - 混合模型

為了充分利用不同模型的優點,研究者們還提出了混合模型的概念。混合模型通過組合不同類型的神經網絡(如FNN、RNN、CNN等),以及引入額外的機制(如注意力機制、記憶網絡等),來實現更復雜的NLP任務。混合模型可以綜合不同模型的特長,提高整體性能。例如,在機器翻譯任務中,可以結合FNN的局部特征提取能力和RNN的序列建模能力,構建出性能更優的翻譯模型。

六、未來展望

隨著深度學習技術的不斷發展,前饋神經網絡在NLP中的應用前景將更加廣闊。未來,我們可以期待以下幾個方面的進展:

- 更高效的模型架構 :研究者們將繼續探索更加高效、緊湊的模型架構,以減少計算資源的需求,提高模型的運行效率。

- 更豐富的語言表示 :隨著預訓練模型的不斷發展,我們將能夠獲得更加豐富、細致的語言表示,為NLP任務提供更加有力的支持。

- 更廣泛的應用場景 :隨著NLP技術的普及和深入應用,FNN等深度學習模型將在更多領域發揮重要作用,如智能客服、智能寫作、智能醫療等。

- 更強大的跨模態處理能力 :未來,FNN等深度學習模型將不僅僅局限于文本處理,還將與圖像、語音等其他模態的數據進行融合,實現跨模態的理解和生成。

總之,前饋神經網絡作為深度學習的一種基本形式,在NLP中發揮著重要作用。通過不斷的創新與發展,FNN將在更多領域展現其獨特的魅力和價值。

-

神經網絡

+關注

關注

42文章

4779瀏覽量

101166 -

人工智能

+關注

關注

1796文章

47666瀏覽量

240272 -

自然語言處理

+關注

關注

1文章

619瀏覽量

13646

發布評論請先 登錄

相關推薦

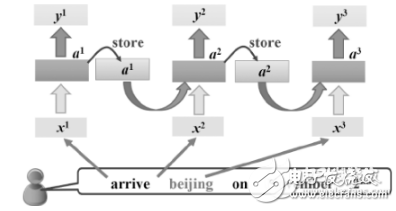

RNN在自然語言處理中的應用

前饋神經網絡在自然語言處理中的應用

前饋神經網絡在自然語言處理中的應用

評論