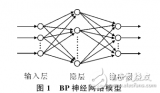

BP神經(jīng)網(wǎng)絡(Backpropagation Neural Network)是一種多層前饋神經(jīng)網(wǎng)絡,其拓撲結(jié)構(gòu)包括輸入層、隱藏層和輸出層。下面詳細介紹BP神經(jīng)網(wǎng)絡的拓撲結(jié)構(gòu)。

- 輸入層

輸入層是BP神經(jīng)網(wǎng)絡的第一層,用于接收外部輸入信號。輸入層的神經(jīng)元數(shù)量取決于問題的特征維度。每個輸入信號通過一個權重與輸入層的神經(jīng)元相連,權重的初始值通常隨機初始化。

- 隱藏層

隱藏層是BP神經(jīng)網(wǎng)絡的核心部分,用于提取特征和進行非線性變換。隱藏層可以有多個,每個隱藏層可以包含不同數(shù)量的神經(jīng)元。隱藏層的神經(jīng)元數(shù)量和層數(shù)取決于問題的復雜性和需要的表達能力。

隱藏層的神經(jīng)元通過權重與輸入層的神經(jīng)元相連,權重的初始值通常隨機初始化。隱藏層的神經(jīng)元使用激活函數(shù)進行非線性變換,常用的激活函數(shù)有Sigmoid函數(shù)、Tanh函數(shù)和ReLU函數(shù)等。

- 輸出層

輸出層是BP神經(jīng)網(wǎng)絡的最后一層,用于生成預測結(jié)果。輸出層的神經(jīng)元數(shù)量取決于問題的輸出維度。輸出層的神經(jīng)元通過權重與隱藏層的神經(jīng)元相連,權重的初始值通常隨機初始化。

輸出層的神經(jīng)元使用激活函數(shù)進行非線性變換,常用的激活函數(shù)有Softmax函數(shù)、Sigmoid函數(shù)和線性函數(shù)等。Softmax函數(shù)常用于多分類問題,Sigmoid函數(shù)常用于二分類問題,線性函數(shù)常用于回歸問題。

- 權重和偏置

BP神經(jīng)網(wǎng)絡中的權重和偏置是網(wǎng)絡的參數(shù),用于調(diào)整神經(jīng)元之間的連接強度。權重和偏置的初始值通常隨機初始化,然后在訓練過程中通過反向傳播算法進行調(diào)整。

權重是神經(jīng)元之間的連接強度,用于調(diào)整輸入信號對神經(jīng)元的影響。偏置是神經(jīng)元的閾值,用于調(diào)整神經(jīng)元的激活狀態(tài)。權重和偏置的值通過訓練數(shù)據(jù)進行優(yōu)化,以最小化預測誤差。

- 激活函數(shù)

激活函數(shù)是BP神經(jīng)網(wǎng)絡中的關鍵組成部分,用于引入非線性,使網(wǎng)絡能夠?qū)W習和模擬復雜的函數(shù)映射。常用的激活函數(shù)有:

- Sigmoid函數(shù):Sigmoid函數(shù)是一種將輸入值壓縮到0和1之間的函數(shù),其數(shù)學表達式為:f(x) = 1 / (1 + exp(-x))。Sigmoid函數(shù)在二分類問題中常用作輸出層的激活函數(shù)。

- Tanh函數(shù):Tanh函數(shù)是一種將輸入值壓縮到-1和1之間的函數(shù),其數(shù)學表達式為:f(x) = (exp(x) - exp(-x)) / (exp(x) + exp(-x))。Tanh函數(shù)在隱藏層中常用作激活函數(shù)。

- ReLU函數(shù):ReLU函數(shù)是一種線性激活函數(shù),其數(shù)學表達式為:f(x) = max(0, x)。ReLU函數(shù)在隱藏層中常用作激活函數(shù),具有計算速度快和避免梯度消失的優(yōu)點。

- Softmax函數(shù):Softmax函數(shù)是一種將輸入值轉(zhuǎn)換為概率分布的函數(shù),其數(shù)學表達式為:f(x) = exp(x) / sum(exp(x))。Softmax函數(shù)在多分類問題中常用作輸出層的激活函數(shù)。

- 損失函數(shù)

損失函數(shù)是衡量BP神經(jīng)網(wǎng)絡預測結(jié)果與真實值之間差異的函數(shù),用于指導網(wǎng)絡的訓練。常用的損失函數(shù)有:

- 均方誤差(MSE):MSE是回歸問題中最常用的損失函數(shù),其數(shù)學表達式為:L = (1/n) * sum((y - ?)^2),其中y是真實值,?是預測值,n是樣本數(shù)量。

- 交叉熵損失(Cross-Entropy Loss):交叉熵損失是分類問題中最常用的損失函數(shù),其數(shù)學表達式為:L = -sum(y * log(?)),其中y是真實標簽的獨熱編碼,?是預測概率。

- Hinge損失:Hinge損失是支持向量機(SVM)中常用的損失函數(shù),用于處理線性可分問題。

- 優(yōu)化算法

優(yōu)化算法是BP神經(jīng)網(wǎng)絡訓練過程中用于更新權重和偏置的算法。常用的優(yōu)化算法有:

- 梯度下降(Gradient Descent):梯度下降是最常用的優(yōu)化算法,通過計算損失函數(shù)關于權重和偏置的梯度,然后更新權重和偏置以最小化損失函數(shù)。

- 隨機梯度下降(Stochastic Gradient Descent, SGD):SGD是梯度下降的一種變體,每次更新只使用一個樣本或一個小批量樣本,可以加快訓練速度。

- 動量(Momentum):動量是一種優(yōu)化技術,通過在梯度下降過程中加入動量項,可以加速收斂并避免陷入局部最小值。

-

拓撲結(jié)構(gòu)

+關注

關注

6文章

325瀏覽量

39313 -

BP神經(jīng)網(wǎng)絡

關注

2文章

115瀏覽量

30603 -

非線性

+關注

關注

1文章

213瀏覽量

23133 -

神經(jīng)元

+關注

關注

1文章

363瀏覽量

18511

發(fā)布評論請先 登錄

相關推薦

bp神經(jīng)網(wǎng)絡模型拓撲結(jié)構(gòu)包括哪些

bp神經(jīng)網(wǎng)絡模型拓撲結(jié)構(gòu)包括哪些

評論