轉自:量子位 | 公眾號 QbitAI

不開玩笑,電影《她》真的來了。

OpenAI最新旗艦大模型GPT-4o,不僅免費可用,能力更是橫跨聽、看、說,絲滑流暢毫無延遲,就像在打一個視頻電話。

現場直播的效果更是炸裂:

它能感受到你的呼吸節奏,也能用比以前更豐富的語氣實時回復,甚至可以做到隨時打斷。

GPT-4o里的“o”是Omni的縮寫,也就是“全能”的意思,接受文本、音頻和圖像的任意組合作為輸入,并生成文本、音頻和圖像輸出。

它可以在短至232毫秒、平均320毫秒的時間內響應音頻輸入,與人類在對話中的反應速度一致。

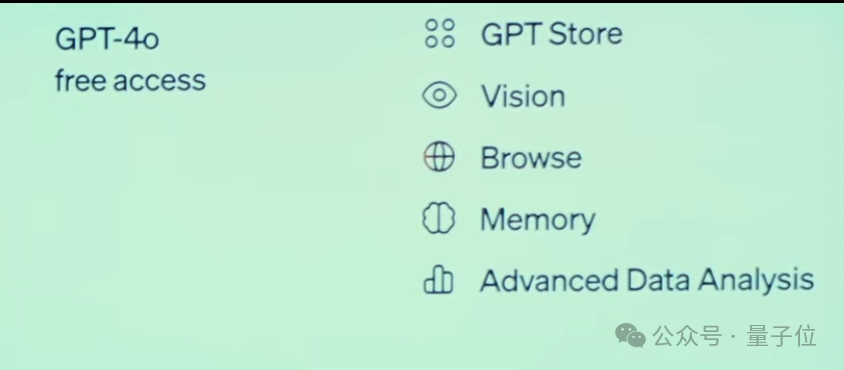

這還是一份給所有人的大禮,GPT4-o與ChatGPT Plus會員版所有的能力,包括視覺、聯網、記憶、執行代碼、GPT Store……

將對所有用戶免費開放!

(新語音模式幾周內先對Plus用戶開放)在直播現場,CTO Murati穆姐說:這是把GPT-4級別的模型開放出去,其實她還謙虛了。

在場外,研究員William Fedus揭秘,GPT-4o就是之前在大模型競技場搞A/B測試的模型之一,im-also-a-good-gpt2-chatbot。

無論從網友上手體驗還是競技場排位來看,都是高于GPT-4-Turbo級別的模型了,ELO分數一騎絕塵。

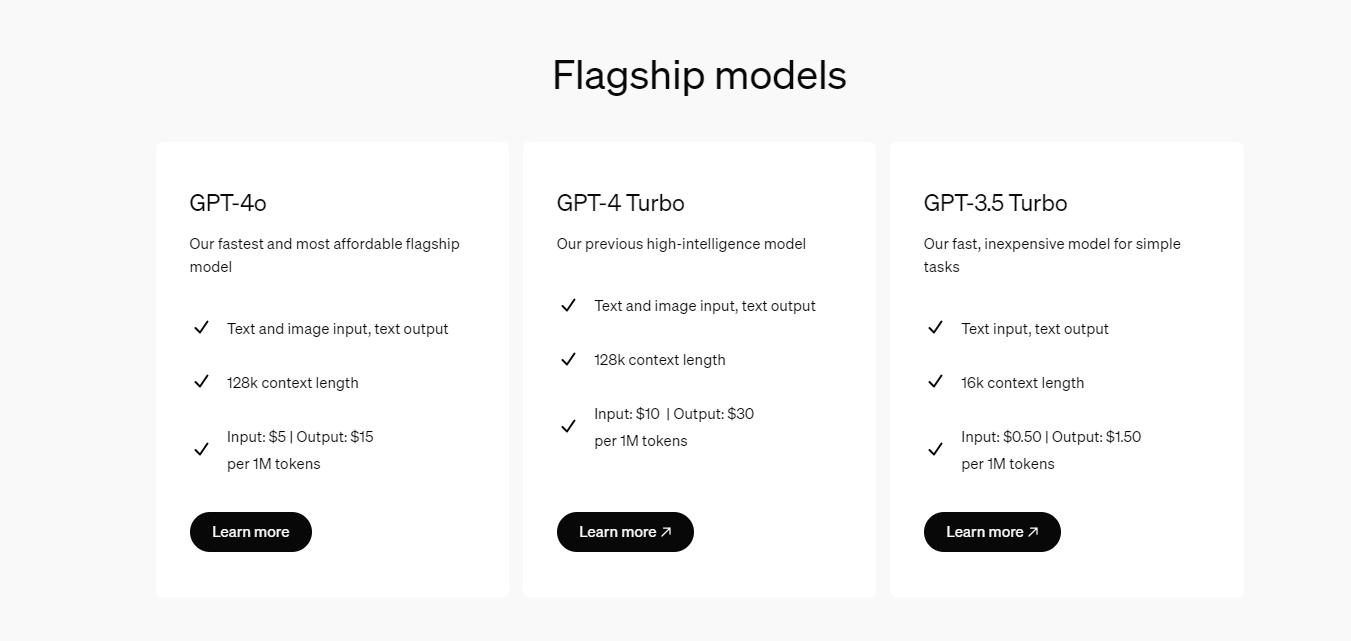

而這樣的超強模型也將提供API,價格打5折,速度提高一倍,單位時間調用次數足足是原來的5倍!

追直播的網友已經在設想可能的應用,可以替代盲人看世界了。以及確實感覺比之前的語音模式體驗上強上不少。

鑒于之前不少人就已經和ChatGPT語音模式“談戀愛”了,有大膽想法的朋友,可以把你們的想法發在評論區了。

總裁Brockman在線演示

知道OpenAI發布會為什么定在谷歌I/O前一天了——打臉,狠狠打臉。

谷歌Gemini發布會需要靠剪輯視頻和切換提示詞達成的偽實時對話效果,OpenAI現場全都直播演示了。

比如讓ChatGPT在語言不通的兩個人之間充當翻譯機,聽到英語就翻譯成意大利語,聽到意大利語就翻譯成英語。

發布會直播之外,總裁哥Brockman還發布了額外的5分鐘詳細演示。而且是讓兩個ChatGPT互相對話,最后還唱起來了,戲劇感直接拉滿。這兩個ChatGPT,一個是舊版APP,只知道對話,另一個則是新版網頁,具備視覺等新能力。(我們不妨取Old和New的首字母,分別叫TA們小O和小N) Brockman首先向小O介紹了大致情況,告訴她要和一個擁有視覺能力的AI對話,她表示很酷并欣然接受。接著,Brockman讓她稍作休息,并向小N也介紹情況,還順帶展示了小N的視覺能力。只見打完招呼后,小N準確地說出了Brockman的衣著打扮和房間環境。而對于要和小O對話這件事,小N也感到很有趣。

Brockman首先向小O介紹了大致情況,告訴她要和一個擁有視覺能力的AI對話,她表示很酷并欣然接受。接著,Brockman讓她稍作休息,并向小N也介紹情況,還順帶展示了小N的視覺能力。只見打完招呼后,小N準確地說出了Brockman的衣著打扮和房間環境。而對于要和小O對話這件事,小N也感到很有趣。

接下來就是小O和小N相互對白的時間了,TA們依然是從Brockman的衣著開始聊起,小O不斷提出新的問題,小N都一一解答。接著,他們又談論了房間的風格、布置和光線,甚至小N還意識到了Brockman正站在上帝視角凝視著TA們。

如果你看了這段視頻就會發現,畫面中出現了一個女人在Brockman身后做了些惡搞的手勢。這可不是亂入,是Brockman和女人串通好,專門給小N設計的一道“考題”。

就在小O和小N聊的正開心的時候,Brockman選擇加入,直接問有沒有看到什么不正常的地方。結果是小N直接識破了Brockman的小伎倆,直接復述出了女人在他身后做小動作的場景,小O聽了之后直接感嘆原來在這里享受樂趣的不只有我們兩個。Brockman把這句話當成了夸贊,并對小O表示了感謝,還愉快地加入了TA們的對話。之后是最后也是最精彩的部分,在Brockman的指揮下,小O和小N根據剛才聊天的內容,直接開啟了對唱模式。只過了簡單幾輪,銜接地就十分密切,而且旋律悠揚,音色也是和真人毫無二致。

最后視頻以Brockman唱出的一句Thank you結束,在視頻外的推文中他還透露新的語音對話功能將在數周內向Plus用戶開放。

端到端訓練,一個神經網絡搞定語音文本圖像

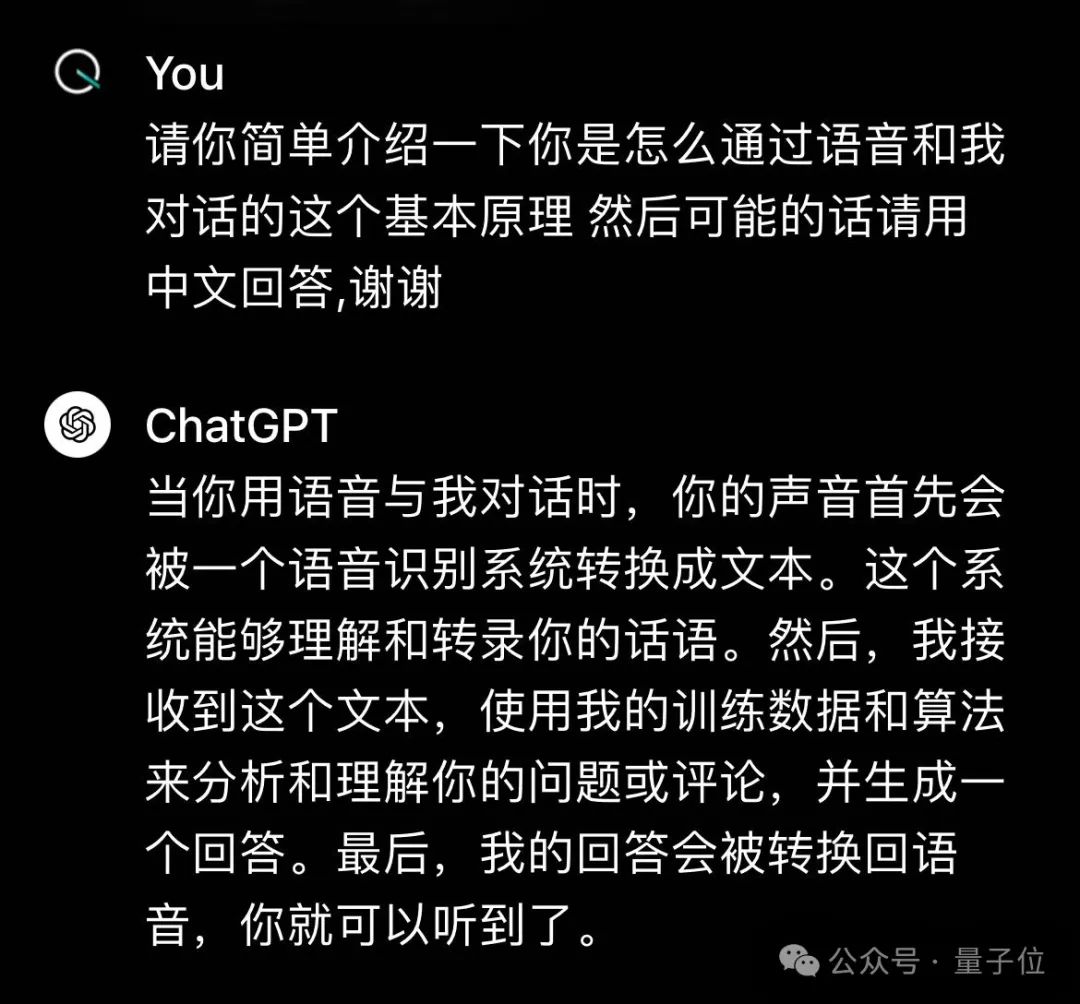

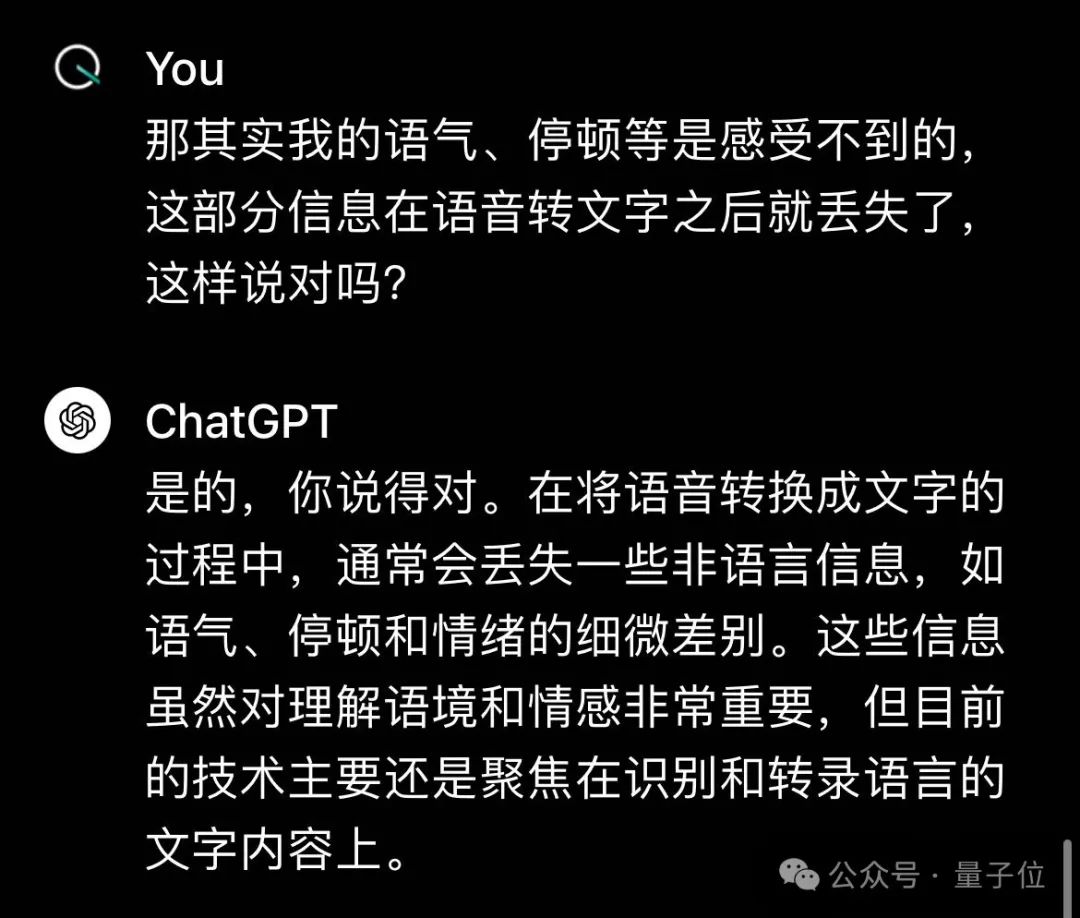

正如奧特曼在發布會前所說,GPT-4o讓人感覺像魔法一樣,那么它是如何做到的呢?非常抱歉,這次非但沒有論文,連技術報告也不發了,只在官網Blog里有一段簡短的說明。在GPT-4o之前,ChatGPT語音模式由三個獨立模型組成,語音轉文本→GPT3.5/GPT-4→文本轉語音。我們也可以讓舊版ChatGPT語音模式自己講一下具體是怎么個流程。 這樣一來,整個系統的延遲足足有2.8秒(GPT-3.5)和5.4秒(GPT-4),而且丟失了大量的信息,它無法直接感受音調、多個說話者或背景噪音,也無法輸出笑聲、唱歌聲,或表達情感。

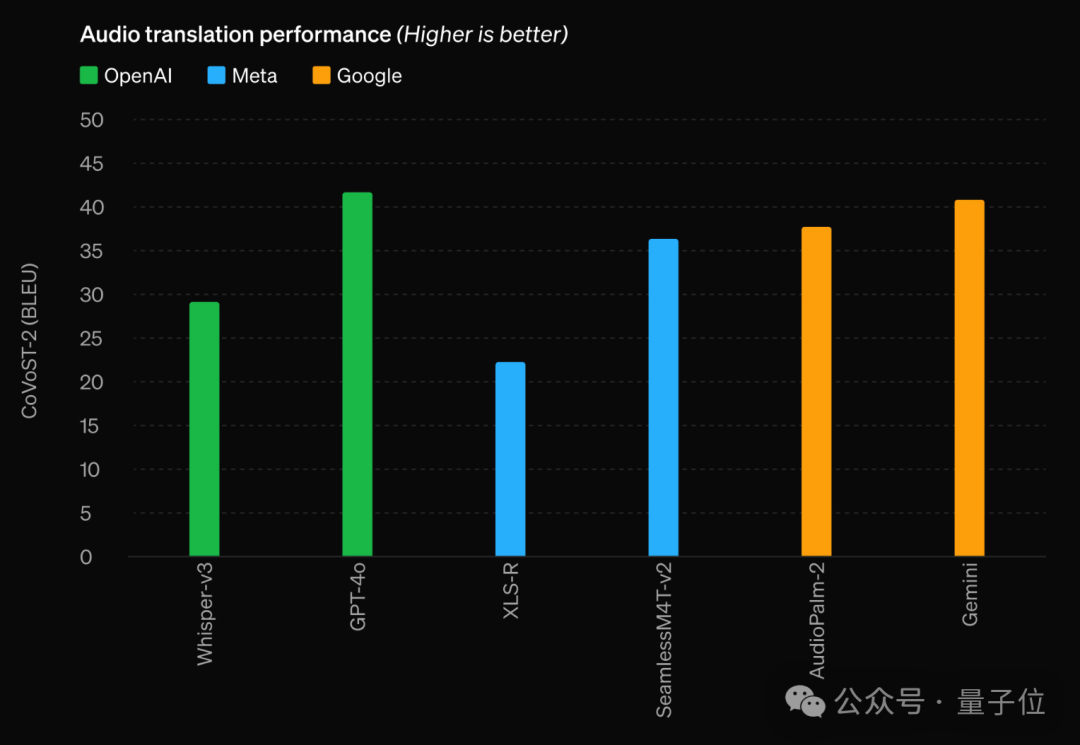

這樣一來,整個系統的延遲足足有2.8秒(GPT-3.5)和5.4秒(GPT-4),而且丟失了大量的信息,它無法直接感受音調、多個說話者或背景噪音,也無法輸出笑聲、唱歌聲,或表達情感。 GPT-4o則是跨文本、視覺和音頻端到端訓練的新模型,這意味著所有輸入和輸出都由同一個神經網絡處理。在語音翻譯任務上,強于OpenAI專門的語音模型Whisper-V3以及谷歌和Meta的語音模型。

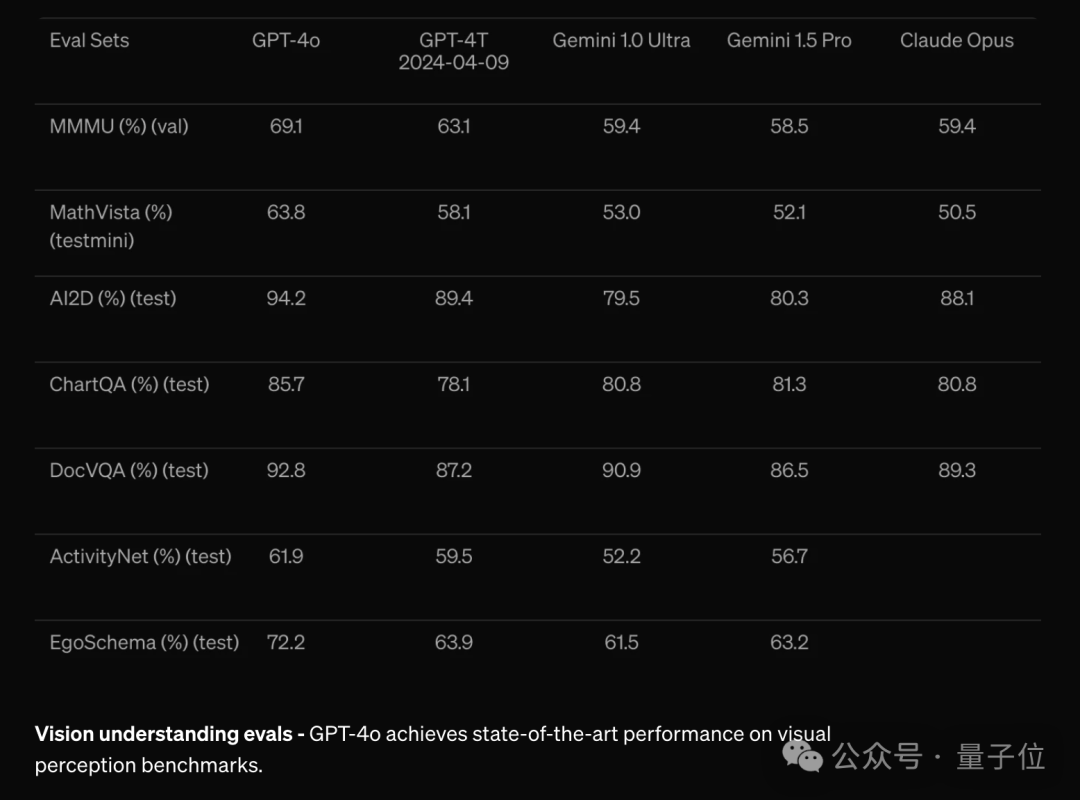

GPT-4o則是跨文本、視覺和音頻端到端訓練的新模型,這意味著所有輸入和輸出都由同一個神經網絡處理。在語音翻譯任務上,強于OpenAI專門的語音模型Whisper-V3以及谷歌和Meta的語音模型。 在視覺理解上,也再次反超Gemini 1.0 Ultra與對家Claude Opus

在視覺理解上,也再次反超Gemini 1.0 Ultra與對家Claude Opus

雖然技術方面這次透露的消息就這么多了,不過也有學者評價。

一個成功的演示相當于1000篇論文。

One More Thing

除了OpenAI帶來的精彩內容之外,也別忘了北京時間5月15日凌晨,谷歌將召開I/O大會。到時量子位將繼續第一時間帶來最新消息。另外根據網友推測,GPT-4o這么強,全都免費開放了,這是勸大家不續訂ChatGPT Plus了的意思嗎?那肯定不是啊~ 鑒于OpenAI春節期間在谷歌發布Gemini 1.5 Pro后半小時左右用Sora狙擊了一把,明天OpenAI還有新活也說不定呢?直播回放

鑒于OpenAI春節期間在谷歌發布Gemini 1.5 Pro后半小時左右用Sora狙擊了一把,明天OpenAI還有新活也說不定呢?直播回放

-

AI

+關注

關注

87文章

31517瀏覽量

270333 -

人工智能

+關注

關注

1796文章

47670瀏覽量

240289 -

GPT

+關注

關注

0文章

360瀏覽量

15505

發布評論請先 登錄

相關推薦

OpenAI報告GPT-4o及4o-mini模型性能下降,正緊急調查

解鎖 GPT-4o!2024 ChatGPT Plus 代升級全攻略(附國內支付方法)

OpenAI解鎖GPT-4o定制功能,助力企業精準優化AI應用

OpenAI提前解鎖GPT-4o語音模式,引領對話新紀元

OpenAI 推出 GPT-4o mini 取代GPT 3.5 性能超越GPT 4 而且更快 API KEY更便宜

國內直聯使用ChatGPT 4.0 API Key使用和多模態GPT4o API調用開發教程!

開發者如何調用OpenAI的GPT-4o API以及價格詳情指南

OpenAI 深夜拋出王炸 “ChatGPT- 4o”, “她” 來了

Azure AI Studio現已支持提供GPT-4o API

GPT-4o更像“人”,AI“疾步”走向商業化應用

GPT-4o深夜炸場!AI實時視頻通話絲滑如人類,Plus功能免費可用

GPT-4o深夜炸場!AI實時視頻通話絲滑如人類,Plus功能免費可用

評論