文章:https://lnkd.in/gcwEeKE3

Python 代碼:https://lnkd.in/ggEK6KwU

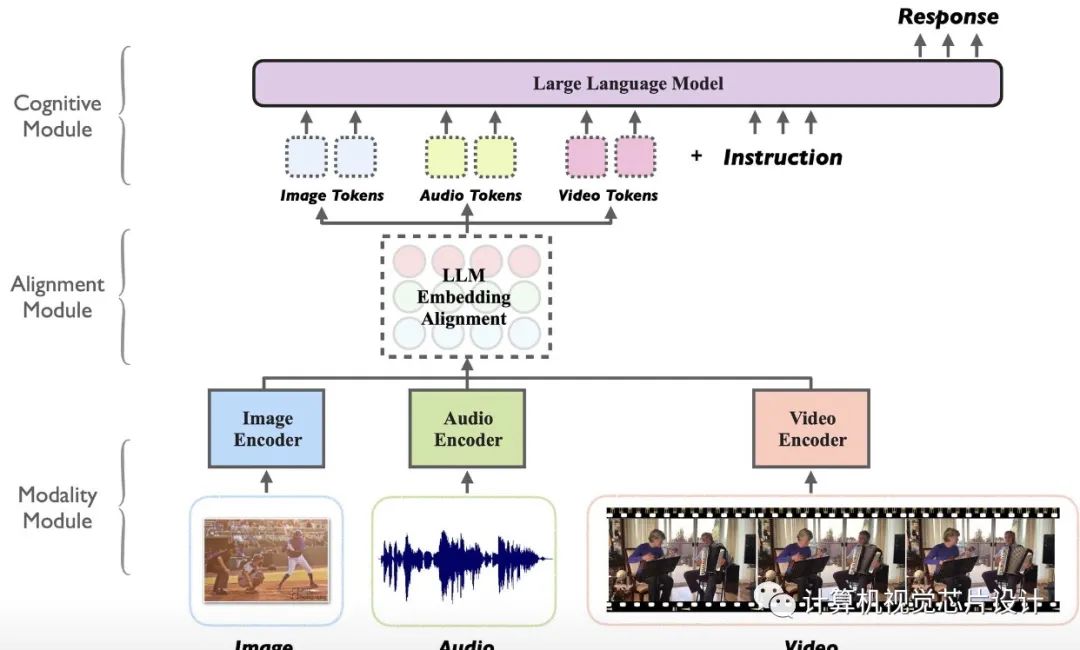

盡管指令調(diào)整的大型語言模型 (LLM) 在各種 NLP 任務中表現(xiàn)出卓越的能力,但它們在文本以外的其他數(shù)據(jù)模式上的有效性尚未得到充分研究。在這項工作中,我們提出了 Macaw-LLM,一種新穎的多模式 LLM,它無縫集成了視覺、音頻和文本信息。

Macaw-LLM 由三個主要組件組成:用于編碼多模態(tài)數(shù)據(jù)的模態(tài)模塊、用于利用預訓練 LLM 的認知模塊以及用于協(xié)調(diào)不同表示的對齊模塊。

我們新穎的對齊模塊將多模態(tài)特征無縫地連接到文本特征,簡化了從模態(tài)模塊到認知模塊的適應過程。

此外,我們在多輪對話方面構建了一個大規(guī)模的多模態(tài)指令數(shù)據(jù)集,包括 69K 圖像實例和 50K 視頻實例。我們已經(jīng)公開了我們的數(shù)據(jù)、代碼和模型,我們希望這可以為多模態(tài) LLM 的未來研究鋪平道路,并擴展 LLM 處理不同數(shù)據(jù)模態(tài)和解決復雜現(xiàn)實場景的能力。

-

模塊

+關注

關注

7文章

2735瀏覽量

47753 -

語言建模

+關注

關注

0文章

5瀏覽量

6278 -

語言模型

+關注

關注

0文章

538瀏覽量

10342 -

LLM

+關注

關注

0文章

299瀏覽量

400

原文標題:Macaw-LLM:具有圖像、音頻、視頻和文本集成的多模態(tài)語言建模

文章出處:【微信號:計算機視覺芯片設計,微信公眾號:計算機視覺芯片設計】歡迎添加關注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

相關推薦

自然語言處理的圖像文本建模相關研究及分析

簡述文本與圖像領域的多模態(tài)學習有關問題

復旦&微軟提出?OmniVL:首個統(tǒng)一圖像、視頻、文本的基礎預訓練模型

微軟多模態(tài)ChatGPT的常見測試介紹

ImageBind:跨模態(tài)之王,將6種模態(tài)全部綁定!

如何利用LLM做多模態(tài)任務?

邱錫鵬團隊提出SpeechGPT:具有內(nèi)生跨模態(tài)能力的大語言模型

邱錫鵬團隊提出具有內(nèi)生跨模態(tài)能力的SpeechGPT,為多模態(tài)LLM指明方向

用圖像對齊所有模態(tài),Meta開源多感官AI基礎模型,實現(xiàn)大一統(tǒng)

VisCPM:邁向多語言多模態(tài)大模型時代

大模型+多模態(tài)的3種實現(xiàn)方法

自動駕駛和多模態(tài)大語言模型的發(fā)展歷程

Macaw-LLM:具有圖像、音頻、視頻和文本集成的多模態(tài)語言建模

Macaw-LLM:具有圖像、音頻、視頻和文本集成的多模態(tài)語言建模

評論