01

摘要

通過(guò)為神經(jīng)機(jī)器翻譯(Neural Machine Translation,NMT)模型配備額外的符號(hào)化知識(shí)庫(kù)(symbolic datastore),k近鄰機(jī)器翻譯(k-nearest-neighbor machine translation, kNN-MT)[1] 框架展示了一種全新的領(lǐng)域自適應(yīng)范式。但是,在構(gòu)建知識(shí)庫(kù)時(shí)通常需要將平行語(yǔ)料中所有的目標(biāo)語(yǔ)言詞語(yǔ)都存儲(chǔ)進(jìn)知識(shí)庫(kù),這樣不僅會(huì)導(dǎo)致知識(shí)庫(kù)規(guī)模過(guò)于龐大,也會(huì)導(dǎo)致知識(shí)庫(kù)中存在大量冗余條目(entry)。為了克服以上問(wèn)題,本文從“NMT模型需要什么樣的額外知識(shí)”這一本質(zhì)問(wèn)題出發(fā),對(duì)知識(shí)庫(kù)構(gòu)建過(guò)程的可解釋性展開了深入的研究。最終,我們提出局部準(zhǔn)確性(local correctness)這一新概念作為解釋角度,它描述了NMT模型在一個(gè)條目及其鄰域空間內(nèi)的翻譯準(zhǔn)確性。從局部準(zhǔn)確性出發(fā),我們建立了NMT模型與知識(shí)庫(kù)之間的聯(lián)系,確定了NMT模型容易犯錯(cuò)并依賴額外知識(shí)的情況。基于局部準(zhǔn)確性,我們也提出了一種簡(jiǎn)單有效的知識(shí)庫(kù)剪枝方案。在兩個(gè)語(yǔ)言對(duì),六個(gè)目標(biāo)領(lǐng)域上的實(shí)驗(yàn)結(jié)果表明,根據(jù)局部準(zhǔn)確性進(jìn)行知識(shí)庫(kù)剪枝能夠?yàn)閗NN-MT系統(tǒng)構(gòu)建一個(gè)更加輕量、可解釋的知識(shí)庫(kù)。

該工作發(fā)表在ACL Findings,由南京大學(xué)自然語(yǔ)言處理組獨(dú)立完成。

本文的預(yù)印本發(fā)布在arXiv:https://arxiv.org/pdf/2211.04052.pdf

相關(guān)代碼發(fā)布在Github:https://github.com/NJUNLP/knn-box

02

NMT模型能力分析

鑒于NMT模型可以不依賴于知識(shí)庫(kù)完成目標(biāo)領(lǐng)域的部分翻譯內(nèi)容,我們推測(cè)NMT模型是掌握目標(biāo)領(lǐng)域的部分雙語(yǔ)知識(shí)的。但是,目前的知識(shí)庫(kù)構(gòu)建過(guò)程卻忽略了這一點(diǎn),導(dǎo)致知識(shí)庫(kù)中存儲(chǔ)了冗余知識(shí)。直覺(jué)上,知識(shí)庫(kù)中只需要存儲(chǔ)能夠修復(fù)NMT模型缺陷的知識(shí)。

為了找到NMT模型的潛在缺陷,構(gòu)建更加可解釋的知識(shí)庫(kù),我們提出以局部準(zhǔn)確性這一新概念作為分析角度。其中,局部準(zhǔn)確性又包含兩個(gè)子概念:條目準(zhǔn)確性(entry correctness)和鄰域準(zhǔn)確性(neighborhood correctness)。基于這些分析工具,我們成功找到了NMT模型的潛在缺陷。以下是對(duì)這些概念和分析過(guò)程的具體介紹:

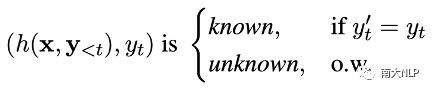

條目準(zhǔn)確性:NMT模型在目標(biāo)領(lǐng)域的翻譯能力很難直接描述,但是檢查NMT模型在每一個(gè)知識(shí)庫(kù)條目上的翻譯準(zhǔn)確性是相對(duì)容易可行的。因此我們首先根據(jù)條目準(zhǔn)確性,判斷NMT模型的翻譯能力。條目準(zhǔn)確性的判定過(guò)程是:針對(duì)知識(shí)庫(kù)中的每一個(gè)條目,我們檢查NMT模型能否根據(jù)隱層表示預(yù)測(cè)出目標(biāo)語(yǔ)言詞語(yǔ)。若可以,則判定該條目為NMT模型掌握的知識(shí)(known entry);若不可以,則判定該條目為NMT模型沒(méi)有掌握的知識(shí)(unknown entry)。

鄰域準(zhǔn)確性:但是,我們注意到僅靠條目準(zhǔn)確性并不能完全反映NMT模型的全部缺陷。因?yàn)榧词箤?duì)于known條目,NMT模型仍然會(huì)在面對(duì)相似上下文時(shí)出現(xiàn)翻譯錯(cuò)誤。因此,為了更加全面地衡量NMT模型的能力,我們基于條目準(zhǔn)確性提出鄰域準(zhǔn)確性的概念,它描述了NMT模型在一個(gè)鄰域空間內(nèi)的翻譯準(zhǔn)確性。為了量化評(píng)估鄰域準(zhǔn)確性這一概念,我們進(jìn)一步提出知識(shí)邊界(knowledge margin,km)指標(biāo)。它的具體定義如下:給定條目(h, y),它的鄰域空間由該位置的k近鄰條目所描述,該位置的知識(shí)邊界值km(h)的計(jì)算方式為:

值得注意的是,知識(shí)邊界的計(jì)算方式可以推廣到表示空間中的任意一點(diǎn),因此可以被用來(lái)考察NMT模型在表示空間中任意一點(diǎn)的能力。

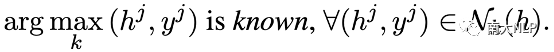

分析實(shí)驗(yàn):下面我們將基于以上概念,以O(shè)PUS數(shù)據(jù)集為例,分析NMT模型與知識(shí)庫(kù)之間的關(guān)系,揭露NMT模型的潛在缺陷。首先,我們統(tǒng)計(jì)了在不同領(lǐng)域知識(shí)庫(kù)中,known條目和unknown條目的占比情況。統(tǒng)計(jì)結(jié)果顯示:知識(shí)庫(kù)中56%-73%的條目都是NMT模型所掌握的(表格1),這也意味著知識(shí)庫(kù)確實(shí)存在極大的冗余。

表格 1 條目準(zhǔn)確性統(tǒng)計(jì)結(jié)果

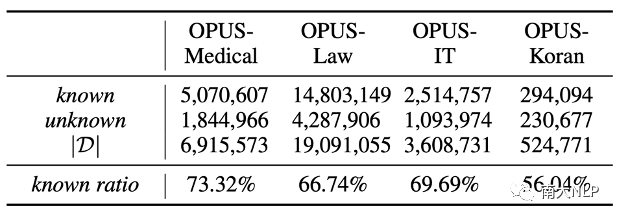

接著,我們衡量了NMT模型在各知識(shí)庫(kù)條目上的鄰域準(zhǔn)確性,并繪制了知識(shí)邊界值分布圖(圖1)。在四個(gè)OPUS領(lǐng)域上,知識(shí)邊界值的分布情況相似:大多數(shù)unknown條目的知識(shí)邊界值很低,而known條目的知識(shí)邊界值則數(shù)值分布差異較大。這說(shuō)明鄰域準(zhǔn)確性與條目準(zhǔn)確性總體上是一致的,但是鄰域準(zhǔn)確性可以更好地展示known條目之間的差異。

圖 1 知識(shí)邊界值分布情況

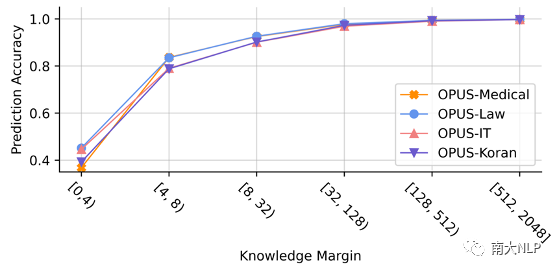

為了進(jìn)一步展示知識(shí)邊界值與NMT模型翻譯能力之間的聯(lián)系,我們?cè)诟鱾€(gè)領(lǐng)域的驗(yàn)證集上進(jìn)行了實(shí)驗(yàn),展示NMT模型在每一個(gè)翻譯步上的翻譯準(zhǔn)確率和知識(shí)邊界值之間的關(guān)系。從圖2中可以看出,對(duì)于知識(shí)邊界值較大的翻譯步,NMT模型的翻譯準(zhǔn)確率高達(dá)95%,但是對(duì)于知識(shí)邊界值較小的翻譯步,NMT模型的翻譯準(zhǔn)確率只有50%左右。這說(shuō)明NMT模型在知識(shí)邊界值小時(shí)是非常容易出現(xiàn)翻譯錯(cuò)誤的,這些位置也是NMT模型的缺陷所在。

圖 2 翻譯準(zhǔn)確率與知識(shí)邊界值之間的關(guān)系

03

基于局部準(zhǔn)確性構(gòu)建可解釋知識(shí)庫(kù)

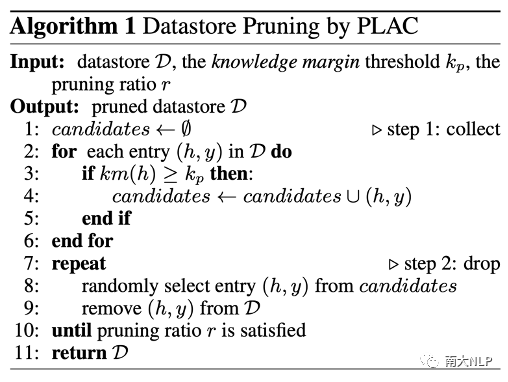

鑒于局部準(zhǔn)確性可以準(zhǔn)確地反映NMT模型的能力強(qiáng)弱,我們也使用其來(lái)衡量知識(shí)庫(kù)條目對(duì)于NMT模型的價(jià)值。基于這種價(jià)值判斷,我們提出了一種新穎的知識(shí)庫(kù)剪枝算法PLAC(Pruning with LocAl Correctness)。該算法的核心思路是去除知識(shí)庫(kù)中知識(shí)邊界值大的條目,因?yàn)樵谶@些位置NMT模型本身的能力很強(qiáng),這些位置的知識(shí)庫(kù)條目對(duì)于NMT模型的價(jià)值較小。PLAC方法的具體算法流程如圖3。該剪枝算法實(shí)現(xiàn)簡(jiǎn)單,不需要訓(xùn)練任何額外神經(jīng)網(wǎng)絡(luò),剪枝后的知識(shí)庫(kù)也可以在不同kNN-MT系統(tǒng)中使用。

圖 3 PLAC剪枝算法偽代碼

04

實(shí)驗(yàn)設(shè)定

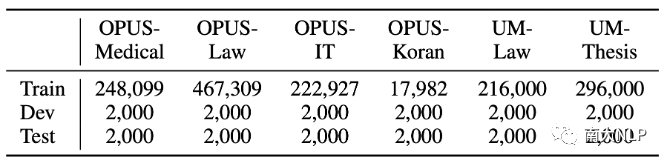

數(shù)據(jù)集:我們?cè)诒姸鄼C(jī)器翻譯領(lǐng)域自適應(yīng)數(shù)據(jù)集上進(jìn)行了知識(shí)庫(kù)剪枝實(shí)驗(yàn),包括四個(gè)德語(yǔ)-英語(yǔ)OPUS數(shù)據(jù)集 [2] 和兩個(gè)中文-英語(yǔ)UM數(shù)據(jù)集 [3]。各數(shù)據(jù)集的具體規(guī)模如表格2所示。

表格 2 數(shù)據(jù)集統(tǒng)計(jì)信息

NMT模型:在德語(yǔ)-英語(yǔ)實(shí)驗(yàn)中,我們使用WMT19德語(yǔ)-英語(yǔ)新聞翻譯任務(wù)的冠軍模型[4]作為預(yù)訓(xùn)練NMT模型。在中文-英語(yǔ)實(shí)驗(yàn)上,我們使用自己在CWMT17中文-英語(yǔ)數(shù)據(jù)上訓(xùn)練的NMT模型作為預(yù)訓(xùn)練NMT模型。

05

實(shí)驗(yàn)結(jié)果

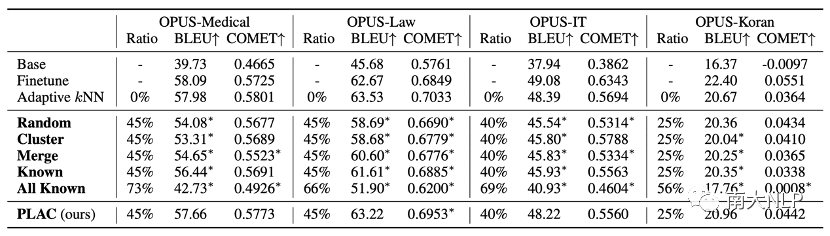

使用PLAC進(jìn)行知識(shí)庫(kù)剪枝是安全可靠的:從OPUS數(shù)據(jù)集上的剪枝實(shí)驗(yàn)結(jié)果可以看出(表格3),PLAC可以在保持翻譯性能不變的情況下,去除25%-45%的知識(shí)庫(kù)條目。尤其是在OPUS-Medical和OPUS-Law這兩個(gè)所需知識(shí)庫(kù)最龐大的領(lǐng)域上,我們的方法成功去除了45%的知識(shí)庫(kù)條目。出色的剪枝效果說(shuō)明使用局部準(zhǔn)確性確實(shí)可以衡量NMT模型的能力以及判斷知識(shí)庫(kù)條目的價(jià)值。

在基線剪枝方法中,Cluster[5]和Merge[6]都造成了巨大的翻譯性能損失,這說(shuō)明即使一部分條目對(duì)應(yīng)相同的目標(biāo)語(yǔ)言詞語(yǔ),這些條目對(duì)于NMT模型的價(jià)值也是不同的。另外,從Known和All Known兩種方法的結(jié)果來(lái)看,僅根據(jù)條目準(zhǔn)確性進(jìn)行剪枝也會(huì)造成性能損失。這說(shuō)明在判斷條目?jī)r(jià)值時(shí),綜合考慮條目準(zhǔn)確性和鄰域準(zhǔn)確性是非常必要的。

表格 3 剪枝實(shí)驗(yàn)結(jié)果(OPUS數(shù)據(jù)集)

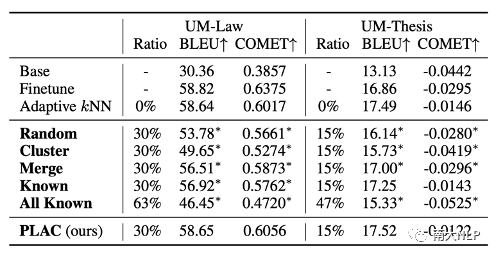

我們也在表格4中報(bào)告了UM數(shù)據(jù)集上的實(shí)驗(yàn)結(jié)果。在不損害翻譯性能的情況下,在UM-Law數(shù)據(jù)集上知識(shí)庫(kù)規(guī)模可以被減少30%,在UM-Thesis數(shù)據(jù)集上知識(shí)庫(kù)規(guī)模可以被減少15%。其余的實(shí)驗(yàn)結(jié)論與OPUS數(shù)據(jù)集上得出的實(shí)驗(yàn)結(jié)論相似。

表格 4 剪枝實(shí)驗(yàn)結(jié)果(UM數(shù)據(jù)集)

知識(shí)邊界閾值對(duì)剪枝效果的影響:在我們提出的方法中,知識(shí)邊界閾值在剪枝過(guò)程中起著重要作用。在圖4中,我們進(jìn)一步展示了該閾值對(duì)剪枝效果的影響。我們發(fā)現(xiàn)在不同領(lǐng)域上,各剪枝方案的剪枝效果有著相同的變化趨勢(shì):PLAC方法總是比其他剪枝方法有著更好的剪枝效果,并且在高剪枝率時(shí)也可以保持更加穩(wěn)定的性能。從圖中還可以看出,知識(shí)邊界閾值的設(shè)定對(duì)BLEU分?jǐn)?shù)和最大剪枝比例有著直接影響:知識(shí)邊界閾值越大,最大剪枝比例越小,翻譯性能損失也越小;知識(shí)邊界閾值越小,最大剪枝比例越大,但是可能造成的翻譯性能損失也會(huì)增大。

圖 4 不同剪枝方案的剪枝效果對(duì)比

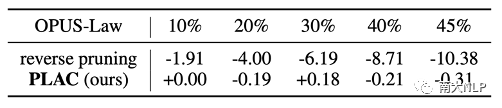

低知識(shí)邊界值知識(shí)條目十分重要:為了驗(yàn)證低知識(shí)邊界值的條目對(duì)NMT模型的價(jià)值,我們采用反向剪枝策略:對(duì)低知識(shí)邊界值進(jìn)行剪枝。表格5中展示了實(shí)驗(yàn)結(jié)果。可以看出,即使在較小的剪枝比例下,反向剪枝策略都會(huì)對(duì)翻譯性能造成巨大的負(fù)面影響,這說(shuō)明這部分知識(shí)庫(kù)條目確實(shí)對(duì)于NMT模型成功進(jìn)行領(lǐng)域自適應(yīng)非常重要。

表格 5 正反向剪枝策略的剪枝效果對(duì)比

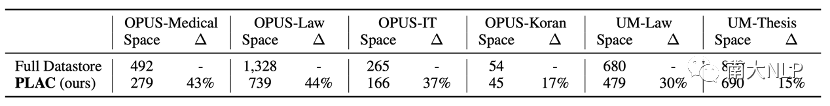

剪枝后的知識(shí)庫(kù)占據(jù)的存儲(chǔ)空間明顯減少:在實(shí)際運(yùn)行kNN-MT系統(tǒng)進(jìn)行翻譯時(shí),知識(shí)庫(kù)需要被載入到CPU和GPU上。因此,知識(shí)庫(kù)的規(guī)模將直接影響翻譯效率。表格6中展示了原始的完整知識(shí)庫(kù)和剪枝過(guò)的輕量知識(shí)庫(kù)之間的大小對(duì)比,可以看出我們提出的剪枝方法可以極大地減小知識(shí)庫(kù)所占用的存儲(chǔ)空間。

表格 6 完整知識(shí)庫(kù)與輕量知識(shí)庫(kù)的存儲(chǔ)占用對(duì)比

06

總結(jié)

在本文中,我們對(duì)神經(jīng)機(jī)器翻譯模型和符號(hào)化知識(shí)庫(kù)之間的關(guān)系展開研究,提出根據(jù)局部準(zhǔn)確性和知識(shí)邊界指標(biāo)判斷NMT模型的潛在缺陷,并發(fā)現(xiàn)NMT模型在知識(shí)邊界值小的情況下常常出現(xiàn)翻譯錯(cuò)誤。基于以上分析,我們進(jìn)一步提出了一種安全可靠的知識(shí)庫(kù)剪枝算法PLAC。實(shí)驗(yàn)結(jié)果表明,我們的剪枝算法可以在不損害翻譯性能的情況下,去除最多45%的知識(shí)庫(kù)條目。出色的剪枝效果也說(shuō)明局部準(zhǔn)確性能夠準(zhǔn)確NMT模型的潛在缺陷和知識(shí)庫(kù)條目的價(jià)值。

-

cpu

+關(guān)注

關(guān)注

68文章

10904瀏覽量

213023 -

模型

+關(guān)注

關(guān)注

1文章

3312瀏覽量

49226 -

機(jī)器翻譯

+關(guān)注

關(guān)注

0文章

139瀏覽量

14947

原文標(biāo)題:ACL2023 | 為k近鄰機(jī)器翻譯領(lǐng)域自適應(yīng)構(gòu)建可解釋知識(shí)庫(kù)

文章出處:【微信號(hào):zenRRan,微信公眾號(hào):深度學(xué)習(xí)自然語(yǔ)言處理】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

面向?qū)ο蟮钠囍苿?dòng)系專家系統(tǒng)及其知識(shí)庫(kù)的構(gòu)建

機(jī)器翻譯三大核心技術(shù)原理 | AI知識(shí)科普

機(jī)器翻譯三大核心技術(shù)原理 | AI知識(shí)科普 2

神經(jīng)機(jī)器翻譯的方法有哪些?

基于知識(shí)庫(kù)的智能策略翻譯技術(shù)

一種基于解釋的知識(shí)庫(kù)綜合

領(lǐng)域知識(shí)庫(kù)的研究與設(shè)計(jì)

一種面向微生物領(lǐng)域的知識(shí)庫(kù)構(gòu)建方法

本體知識(shí)庫(kù)的模塊與保守?cái)U(kuò)充

本體知識(shí)庫(kù)的構(gòu)建

阿里巴巴機(jī)器翻譯在跨境電商場(chǎng)景下的應(yīng)用和實(shí)踐

從冷戰(zhàn)到深度學(xué)習(xí),機(jī)器翻譯歷史不簡(jiǎn)單!

機(jī)器翻譯中細(xì)粒度領(lǐng)域自適應(yīng)的數(shù)據(jù)集和基準(zhǔn)實(shí)驗(yàn)

機(jī)器翻譯研究進(jìn)展

為k近鄰機(jī)器翻譯領(lǐng)域自適應(yīng)構(gòu)建可解釋知識(shí)庫(kù)

為k近鄰機(jī)器翻譯領(lǐng)域自適應(yīng)構(gòu)建可解釋知識(shí)庫(kù)

評(píng)論