2. 引言

介紹一篇關(guān)于概率生成模型非常有意思的工作,保持了Aleksander Madry一如既往的風(fēng)格。眾所周知,深度學(xué)習(xí)徹底改變了計算機視覺問題的的研究范式,提供了很多原來大家想完成但沒有機遇完成的工作。而這場演化確是從判別模型開始的,像Alexnet、VGG、ResNet這些工作取得的非凡進展,引發(fā)了深度學(xué)習(xí)范式的擴展。

而慢慢地,大家的注意力也從包括更復(fù)雜的任務(wù),如圖像生成和圖像到圖像的轉(zhuǎn)換這種生成式的任務(wù)。但這種生成模型在很大程度上都是基于非常復(fù)雜的,而且基于特定任務(wù)的技術(shù),例如GAN和VAE。所以可能就目前的進展來看,生成任務(wù)的范式是比較復(fù)雜的,但是果真所有的生成任務(wù)都這么復(fù)雜么?本文提供了一個比較新穎的角度。

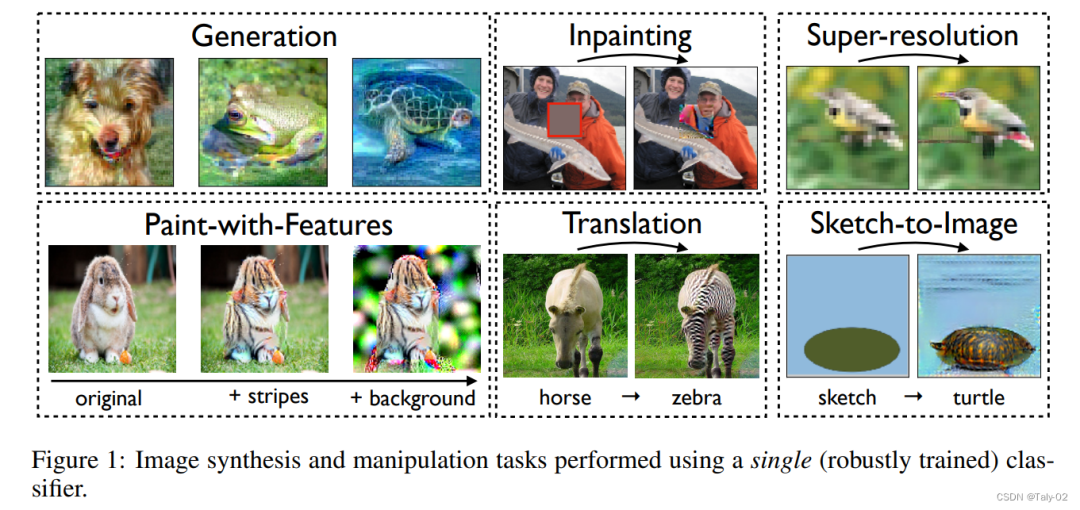

本文提供了一種方法,僅憑基本分類工具就足以解決各種圖像合成任務(wù),包括generation、inpainting、image-to-image translation、super-resolution、interactive image manipulation。論文提出的整個框架都是基于每個數(shù)據(jù)集的單個分類器,而且僅僅只涉及執(zhí)行一個簡單的輸入操作:使用梯度最大化地下降使預(yù)測的類分數(shù)。

因此,這一較為通用的方法比較易于實現(xiàn)和訓(xùn)練。其實論文提出方法最關(guān)鍵的成分是adversarially robust classifiers。此前,其實就有模型觀察到觀察到,將魯棒模型在輸入上的損失最大化,將導(dǎo)致其他類的狀態(tài)更接近真實的分布(maximizing the loss of robust models over the input leads to realistic instances of other classes)。

因此,基于這種結(jié)論,論文的研究結(jié)果建立了健壯的分類器作為語義圖像操作的強大manipulation。為了突出核心方法本身的潛力,論文的實驗中有意采用一種通用的分類設(shè)置,而沒有任何額外的優(yōu)化。

2. 方法

論文首先介紹了作為Input Manipulation的Robust Models,

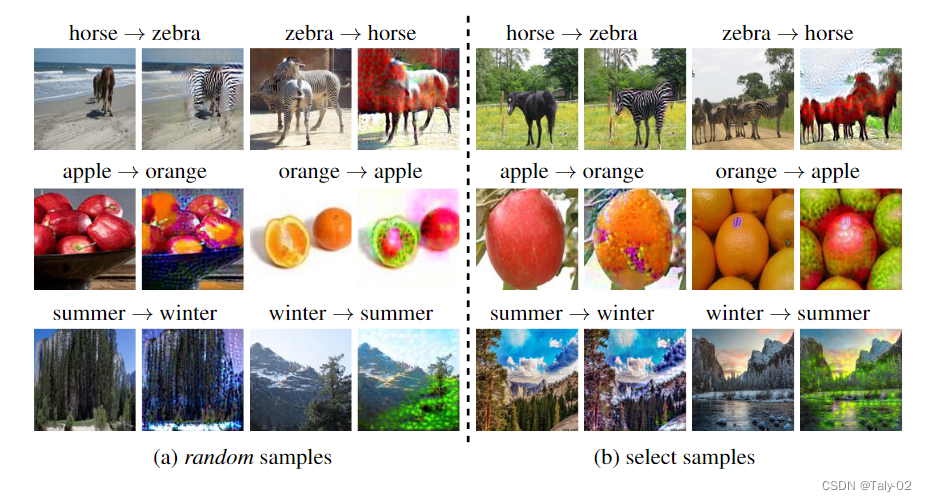

其實從這個視角來看,我們可以將魯棒優(yōu)化看作是將先驗編碼到模型中,防止它依賴于輸入的難以察覺的特征。的確,也就是說,這種訓(xùn)練方式可以通過鼓勵模型對小擾動不銘感,從而使得Robust training的預(yù)測變化與輸入變化的顯著性相對應(yīng)。事實上,當我們最大化一個Robust Models的特定類面對目標攻擊的敏感概率時,這種現(xiàn)象也會出現(xiàn)——參見圖2中的說明。

這表明,穩(wěn)健的模型表現(xiàn)出更多與人類一致的梯度,更重要的是,我們可以通過對模型輸出執(zhí)行梯度下降來精確控制輸入中的特征。在接下來的工作中,論文闡釋了魯棒模型的這一特性足以在不同的圖像合成任務(wù)集上獲得良好的性能。論文還是反復(fù)強調(diào),要獲取和自然數(shù)據(jù)domain相近質(zhì)量的質(zhì)量其實只需要充分利用分類模型就行了,GAN和VAE這些模型雖然取得了不錯的效果,但是還是對分類模型的潛力有所忽略。

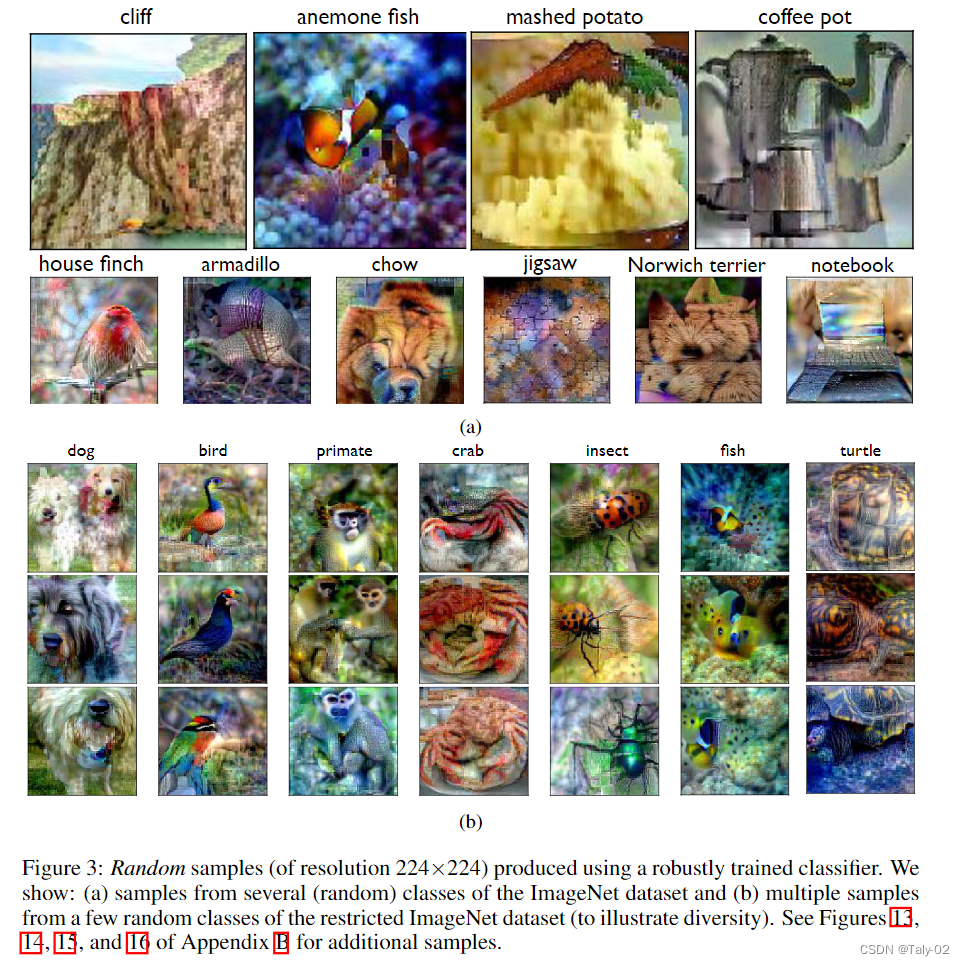

3.1 Realistic Image Generation

講了這么多繞來繞去的,那論文優(yōu)化目標是什么呢(中文解釋起來太復(fù)雜也可能不準確,還是看原文):

其實就是做了一個非常簡單的假設(shè),使得模型能夠利用class-conditional distribution的混合高斯的多元模型中,重建出相應(yīng)的圖像,優(yōu)化目標就是使得符合最小的期望。那么效果如何呢,作者隨機選取了異步的的可視化:

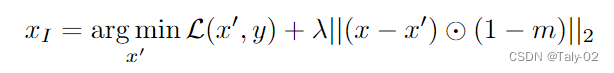

3.2 Inpainting

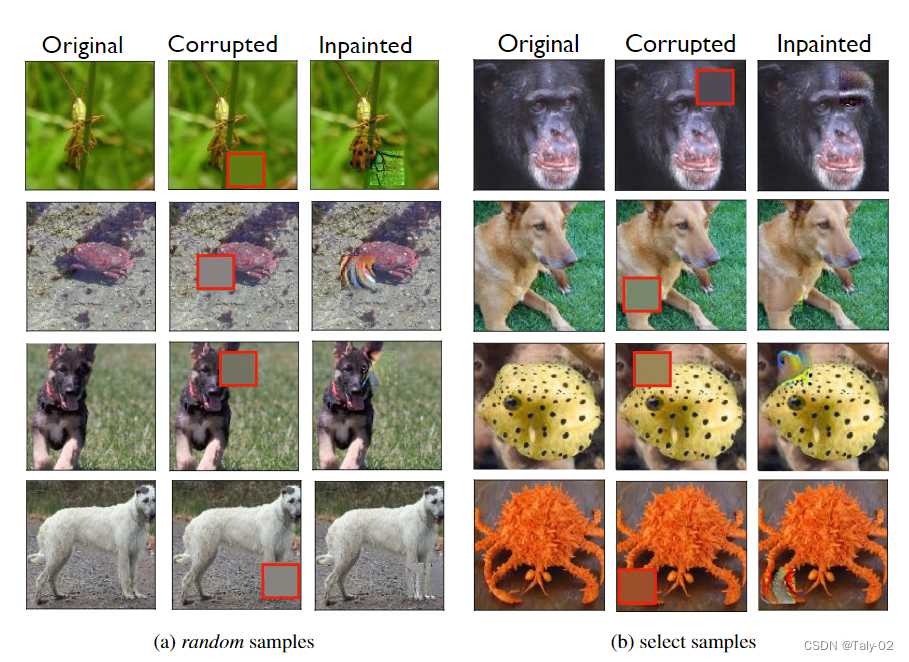

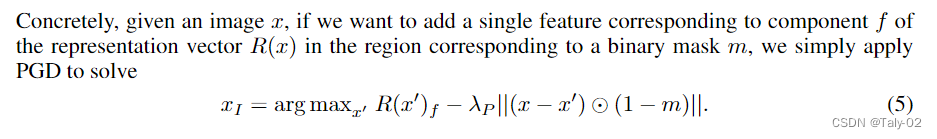

對于inpainting,是指恢復(fù)具有大區(qū)域被mask掉的圖像。也就是說給定一個圖像x,在一個對應(yīng)于二值掩碼m的區(qū)域中的內(nèi)容進行補充,inpainting的目標是以一種相對于圖像其余部分感知上合理的方式恢復(fù)丟失的像素。作者發(fā)現(xiàn),簡單的feed分類器,當經(jīng)過robust的訓(xùn)練時,可以成為這類圖像重建任務(wù)的強大工具。

其實根據(jù)上一部分我們的描述,其實可以發(fā)現(xiàn)我們的目標也是使用魯棒的模型來恢復(fù)圖像中缺失的特征。為此,我們將優(yōu)化圖像,使底層真實類的分數(shù)最大化,同時也迫使其在未損壞的區(qū)域與原始一致。具體來說,給定一個訓(xùn)練在未損壞數(shù)據(jù)上的魯棒分類器,和一個帶有標簽y的損壞圖像z,然后對優(yōu)化目標進行求解:

可以發(fā)現(xiàn)效果確實還不錯:

3.3 Image-to-Image Translation

這個其實就跟3.1非常類似了。在本節(jié)中,我們將演示魯棒分類器為執(zhí)行這種圖像到圖像轉(zhuǎn)換提供了一種新的方法。關(guān)鍵是(robustly)訓(xùn)練分類器來區(qū)分源域和目標域。從概念上講,這樣的分類器將提取每個領(lǐng)域的顯著特征,以便做出準確的預(yù)測。然后,我們可以通過直接最大化目標域的預(yù)測得分來翻譯來自源域的輸入。

3.4 Interactive Image Manipulation

這個的優(yōu)化目標和3.2類似。

4. 結(jié)論

在這項工作中,我們利用基本分類框架來執(zhí)行廣泛的圖像合成任務(wù)。特別是,我們發(fā)現(xiàn)基本分類器學(xué)習(xí)到的特征足以完成所有這些任務(wù),前提是該分類器具有adversarially robust。然后,論文非常生動地展示這種insight如何產(chǎn)生一個簡單、可靠、直接可擴展到其他大型數(shù)據(jù)集的toolkit。

事實上,與GAN這些方法不同的是,我論文的方法實際上受益于擴展到更復(fù)雜的數(shù)據(jù)集——只要底層分類任務(wù)豐富且具有挑戰(zhàn)性,分類器就可能學(xué)習(xí)更細粒度的特征。實際上,魯棒性可能為構(gòu)建一個與人類更加一致的機器學(xué)習(xí)工具包提供了一條道路。

-

模型

+關(guān)注

關(guān)注

1文章

3313瀏覽量

49227 -

機器學(xué)習(xí)

+關(guān)注

關(guān)注

66文章

8439瀏覽量

133087 -

數(shù)據(jù)集

+關(guān)注

關(guān)注

4文章

1209瀏覽量

24835

原文標題:NeurIPS19 用分類模型完成生成任務(wù)

文章出處:【微信號:GiantPandaCV,微信公眾號:GiantPandaCV】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

相關(guān)推薦

基于多通道分類合成的SAR圖像分類研究

pyhanlp文本分類與情感分析

NLPIR平臺在文本分類方面的技術(shù)解析

基于文章標題信息的漢語自動文本分類

如何使用Spark計算框架進行分布式文本分類方法的研究

文本分類的一個大型“真香現(xiàn)場”來了

基于深度神經(jīng)網(wǎng)絡(luò)的文本分類分析

融合文本分類和摘要的多任務(wù)學(xué)習(xí)摘要模型

利用基本分類框架來執(zhí)行廣泛的圖像合成任務(wù)

利用基本分類框架來執(zhí)行廣泛的圖像合成任務(wù)

評論