本文介紹了廣義線性模型,其中線性回歸、logistic回歸,softmax回歸同屬于廣義線性模型。從指數分布家族推導出高斯分布、伯努利分布對應的指數分布家族形式,以最大化期望為目標推導出線性回歸、logistic回歸,softmax回歸的目標函數,進一步強調模型的概率解釋性。

廣義線性模型

從線性回歸,logistic回歸,softmax回歸,最大熵的概率解釋來看,我們會發現線性回歸是基于高斯分布+最大似然估計的結果,logistic回歸是伯努利分布+對數最大似然估計的結果,softmax回歸是多項分布+對數最大似然估計的結果,最大熵是基于期望+對數似然估計的結果。前三者可以從廣義線性模型角度來看。

A、指數分布家族

指數分布家族是指可以表示為指數形式的概率分布,指數分布的形式如下:

其中是分布的自然參數,是充分統計量,通常. 當參數都固定的時候,就定義了一個以為參數的函數族。

實際上大多數的概率分布都屬于指數分布家族,比如:

1)伯努利分布 0-1問題

2)二項分布,多項分布 多取值 多次試驗

3)泊松分布 計數過程

4)伽馬分布與指數分布

5)分布

6)Dirichlet分布

7)高斯分布

現在我們將高斯分布和伯努利分布用指數分布家族的形式表示:

高斯分布:

對應到指數分布家族有:

伯努利分布:

對應到指數分布家族有:

B、廣義線性模型

在了解指數分布家族之后,我們再來看廣義線性模型的形式定義與假設:

1)給定樣本x與參數,樣本分類y服從指數分布家族的某個分布。

2)給定一個x,我們目標函數為:

3)

三條假設,第一條是為了能在指數分布范圍內討論y的概率,第二條假設是為了使得預測值服從均值為實際值得一個分布,第三條假設是為了設計的決策函數(模型)是線性的。

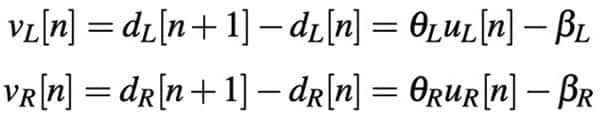

由高斯分布的指數家族分布形式與廣義線性模型的定義有線性回歸的模型為:

同樣由伯努利分布的指數家族分布形式與廣義線性模型的定義有logistic回歸的模型為(解釋了為什么是sigmoid函數):

所以,在廣義線性模型中,決策函數為線性函數是基于廣義線性模型的第三條假設,而最終的模型是依賴于模型服從什么樣的分布,比如 高斯分布,伯努利分布。

同樣,我們應用logistic回歸到softmax回歸的一套定義,下面再來看多項分布對應的softmax回歸:

其中是表示的概率,是一個指示函數,為真是取值為,否則為,采用softmax中向量化的定義。

對應到指數分布家族有:

由推出:

為了方便定義,由于多項分布所有值取值概率加和為1有:

所以有:

再由廣義線性模型的第二條假設,同時將第三條線性假設帶入有:

最后由最大似然估計有softmax的目標函數如下:

到此,廣義線性模型解釋線性回歸,logistic回歸,softmax回歸基本算完,可以看出線性函數是基于廣義線性模型的第三條假設,采用sigmoid函數是因為伯努利分布,而softmax回歸是logistic回歸高維推廣。

-

函數

+關注

關注

3文章

4346瀏覽量

62978 -

線性

+關注

關注

0文章

199瀏覽量

25202 -

模型

+關注

關注

1文章

3313瀏覽量

49232

原文標題:【機器學習】知否?知否?廣義線性模型

文章出處:【微信號:AI_Thinker,微信公眾號:人工智能頭條】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

【「大模型啟示錄」閱讀體驗】對大模型更深入的認知

構建語音控制機器人 - 線性模型和機器學習

廣義線性模型介紹

廣義線性模型介紹

評論